- OpenAI führt einen Sicherheitsplan ein, der dem Vorstand ein Vetorecht bei risikoreichen KI-Entwicklungen einräumt.

- Der Bereitschaftsrahmen beschreibt Prozesse zur Bewertung und Minderung katastrophaler Risiken im Zusammenhang mit leistungsstarken KI-Modellen.

- OpenAI richtet Sicherheits-, Super-Alignment- und Bereitschaftsteams ein, um verschiedene KI-Risikokategorien zu überwachen und zu bewerten.

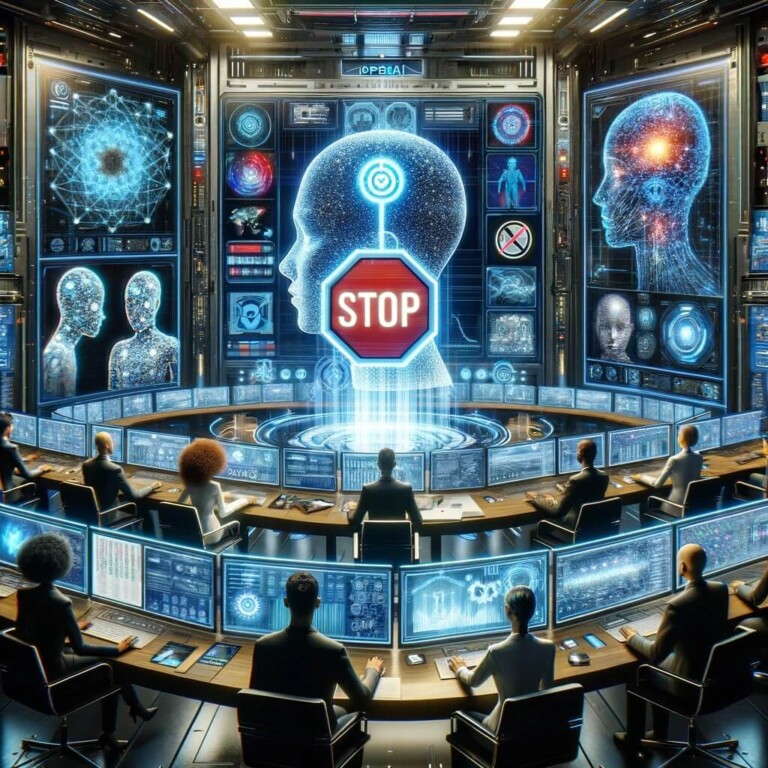

OpenAI hat eine neue Sicherheitsinitiative vorgestellt, die dem Aufsichtsrat die Befugnis einräumt, CEO Sam Altman zu überstimmen, falls die mit der KI-Entwicklung verbundenen Risiken als zu hoch eingeschätzt werden. Diese umfassende Strategie, der sogenannte „Preparedness Framework“, zielt darauf ab, bestehende Lücken in der Erforschung von KI-Risiken zu schließen und Sicherheitsprotokolle zu systematisieren. Der Rahmen beschreibt die Prozesse von OpenAI zur Überwachung, Bewertung, Prognose und Abwehr katastrophaler Risiken, die von immer leistungsfähigeren KI-Modellen ausgehen.

Rahmen für risikoreiche KI-Entwicklungen

Im Rahmen dieser ambitionierten Initiative wird OpenAI spezialisierte Teams einrichten, die verschiedene Aspekte der Risiken in der KI-Entwicklung überwachen. Die Teams für Sicherheitssysteme konzentrieren sich auf potenziellen Missbrauch und Risiken bestehender KI-Modelle wie ChatGPT. Parallel dazu prüft das Bereitschaftsteam zukunftsweisende Modelle, während ein spezielles Team für die Entwicklung hochentwickelter KI-Modelle die Entwicklung solcher Modelle engmaschig begleitet. Alle diese Teams unterstehen der Aufsicht des Verwaltungsrats.

Während OpenAI die Entwicklung einer KI vorantreibt, die die menschliche Intelligenz übertrifft, betont das Unternehmen die Notwendigkeit, zukünftige Herausforderungen frühzeitig zu erkennen. Neue Modelle werden rigoros getestet, bis an ihre Grenzen gebracht und anschließend anhand von vier Risikokategorien bewertet: Cybersicherheit, Überzeugung (Lügen und Desinformation), Modellautonomie (autonome Entscheidungsfindung) und CBRN (chemische, biologische, radiologische und nukleare Bedrohungen). Jede Kategorie erhält eine Risikobewertung – niedrig, mittel, hoch oder kritisch – gefolgt von einer Bewertung nach erfolgten Risikominderungsmaßnahmen. Die Implementierung erfolgt bei mittlerem oder niedrigem Risiko, wird bei hohem Risiko mit Vorsichtsmaßnahmen fortgesetzt und bei kritischem Risiko gestoppt. OpenAI verpflichtet sich zudem zu Transparenz und zieht im Problemfalldent Dritte für Audits hinzu.

OpenAIs Ansatz zur KI-Sicherheit und die zukünftigen Auswirkungen

OpenAI legt größten Wert auf die Förderung umfassender Zusammenarbeit, sowohl extern als auch innerhalb des komplexen Netzwerks seiner internen Teams, insbesondere im Bereich Sicherheitssysteme. Diese kollaborative Synergie wird aktiv für die sorgfältige Überwachung und Eindämmung von Missbrauch in der Praxis genutzt. OpenAI erweitert diesen kollaborativen Ansatz und dehnt seine Kooperationsbemühungen nahtlos auf den Bereich der Superalignment aus. Hierbei liegt der Fokus strategisch auf der präzisendentund anschließenden Behebung von Risiken, die durch Fehlausrichtungen entstehen.

OpenAI ist mit seinem unermüdlichen Engagement für die Erweiterung des Wissens ein Vorreiter in der Forschung. Ein besonderer Schwerpunkt dieses kontinuierlichen Innovationsstrebens liegt in der detaillierten Untersuchung der komplexen Dynamiken, die die Entwicklung von Risiken im Zusammenhang mit der exponentiellen Skalierung von Modellen bestimmen. Das übergeordnete Ziel dieser wissenschaftlichen Forschung ist ambitioniert: Risiken frühzeitig zu prognostizieren. Dieses ehrgeizige Ziel basiert auf der strategischen Nutzung von Erkenntnissen aus früheren Erfolgen, insbesondere solchen, die auf der Einhaltung von Skalierungsgesetzen beruhen.

Während OpenAI einen monumentalen Schritt in Richtung KI-Sicherheit, bleiben Fragen zu den Auswirkungen der Vetomöglichkeit des Aufsichtsrats gegenüber dem CEO bestehen. Wird diese Entscheidung das richtige Gleichgewicht zwischen Innovation und Vorsicht herstellen? Wie effektiv wird der Vorbereitungsrahmen sein, um die mit der Entwicklung fortschrittlicher KI-Modelle verbundenen Risiken vorherzusehen und zu minimieren? Die Zeit wird zeigen, ob dieser mutige Schritt OpenAI als Vorreiter verantwortungsvoller KI-Entwicklung positioniert oder ob er Debatten über das Verhältnis von Autorität und Innovation im sich ständig weiterentwickelnden Feld der künstlichen Intelligenz auslöst.

Wenn Sie das hier lesen, sind Sie schon einen Schritt voraus. Bleiben Sie mit unserem Newsletter auf dem Laufenden.

Haftungsausschluss. Die bereitgestellten Informationen stellen keine Anlageberatung dar. Cryptopolitan/ übernimmt keine Haftung für Investitionen, die auf Grundlage der Informationen auf dieser Seite getätigt werden. Wirtrondentdentdentdentdentdentdentdent oder einen qualifizierten Fachmann zu konsultieren

CRASH-KURS

- Mit welchen Kryptowährungen kann man Geld verdienen?

- Wie Sie Ihre Sicherheit mit einer digitalen Geldbörse erhöhen können (und welche sich tatsächlich lohnen)

- Wenig bekannte Anlagestrategien, die Profis anwenden

- Wie man mit dem Investieren in Kryptowährungen beginnt (welche Börsen man nutzen sollte, welche Kryptowährung am besten zum Kauf geeignet ist usw.)