Сотрудники утверждают, что OpenAI и Google DeepMind скрывают риски, связанные с искусственным интеллектом

- Бывшие сотрудники обвиняют компании, занимающиеся искусственным интеллектом, в сокрытии рисков, которые могут привести к вымиранию человечества.

- Говорят, что компании ставят прибыль на первое место, избегая при этом «эффективного контроля»

- Информаторов отпугивает угроза мести со стороны работодателей.

Несколько нынешних и бывших сотрудников OpenAI и Google DeepMind обвинили свои компании в сокрытии рисков, связанных с искусственным интеллектом, которые потенциально могут привести к вымиранию человечества. В открытом письме работники заявили, что компании, занимающиеся ИИ, ставят прибыль на первое место, избегая при этом «эффективного [государственного] надзора»

Читайте также: OpenAI разрабатывает преемника GPT-4 на фоне опасений по поводу безопасности.

Открытое письмо подписали 11 бывших сотрудников OpenAI, двое из Google DeepMind, и его поддержал «крестный отец ИИ» Джеффри Хинтон, ранее работавший в Google. В нем говорится, что стремление к прибыли и лазейки в законодательстве позволяют компаниям скрывать угрозы, исходящие от передового искусственного интеллекта.

Искусственный интеллект может привести к «вымиранию человечества»

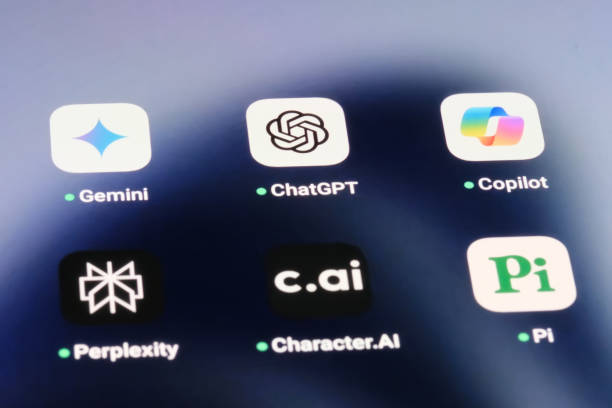

Согласно письму, компании, занимающиеся искусственным интеллектом, такие как OpenAI и Google DeepMind, создатель Gemini, не публиковали информацию о неадекватных мерах защиты и уровнях риска своих систем, поскольку они не обязаны это делать.

Без регулирующего надзора программы искусственного интеллекта могут нанести серьезный вред людям. Сотрудники предупредили:

«Эти риски варьируются от дальнейшего усугубления существующего неравенства… до потери контроля над автономными системами искусственного интеллекта, что потенциально может привести к вымиранию человечества»

Как отмечают подписавшие письмо, сами компании, занимающиеся ИИ, признают эти риски. В мае 2023 года генеральные директора OpenAI, Anthropic и Google DeepMind совместно подписали открытое письмо Центра безопасности ИИ. В письме просто говорилось: «Снижение риска исчезновения ИИ должно стать глобальным приоритетом наряду с другими рисками социального масштаба, такими как пандемии и ядерная война».

Компании, занимающиеся разработкой ИИ, все чаще подвергаются критике за то, что ставят новые продукты и прибыль выше безопасности. ChatGPT, отметила опасения, высказанные в письме, и заявила, что работает над созданием безопасного искусственного интеллекта.

«Мы гордимся своим tracсоздания самых эффективных и безопасных систем искусственного интеллекта и верим в наш научный подход к управлению рисками», — заявила New York Times.

«Мы согласны с тем, что в свете значимости этой технологии крайне важны серьезные дискуссии, и мы продолжим взаимодействовать с правительствами, гражданским обществом и другими сообществами по всему миру»

Информаторы опасаются мести

Бывшие сотрудники OpenAI и Google заявили, что хотели бы выполнять надзорную функцию, пока регулирующие органы разрабатывают законы, обязывающие разработчиков ИИ публично раскрывать больше информации о своих программах.

Однако соглашения оdentи вероятность ответных мер со стороны работодателей отбивают у работников желание публично высказывать свои опасения. В письме говорится:

«Учитывая историю подобных случаев в отрасли, некоторые из нас вполне обоснованно опасаются различных форм мести. Мы не первые, кто сталкивается с этими проблемами или говорит о них»

В США лица, сообщающие о нарушениях, защищены законом, но на тех, кто говорит об опасностях искусственного интеллекта, эта защита не распространяется, поскольку данная технология еще не регулируется.

Читайте также: ChatGPT продолжает распространять ложную информацию, заявляет европейский орган по защите данных.

В письме содержался призыв к компаниям, занимающимся разработкой искусственного интеллекта, содействовать получению проверяемой анонимной обратной связи, поддерживать культуру открытой критики и не преследовать осведомителей.

Исследователь в области искусственного интеллекта Лэнс Б. Элиот заявил, что компании применяют метод «кнута и пряника» к критике. Сотрудники, которые не высказываются против рисков, получают вознаграждение в виде повышения по службе и увеличения заработной платы.

С другой стороны, информаторы и критики теряют свои опционы на акции, могут быть вынуждены покинуть компанию и быть тайно внесены в черный список сообществом лидеров в области искусственного интеллекта.

Cryptopolitan репортажи Джеффри Гого

Если вы это читаете, значит, вы уже впереди. Оставайтесь на шаг впереди, подписавшись на нашу рассылку.

Предупреждение. Предоставленная информация не является торговой рекомендацией. Cryptopolitanнастоятельно не несет ответственности за любые инвестиции, сделанные на основе информации, представленной на этой странице. Мыtrondentdentdentdentdentdentdentdent и/или проконсультироваться с квалифицированным специалистом, прежде чем принимать какие-либо инвестиционные решения.

КУРС

- Какие криптовалюты могут принести вам деньги?

- Как повысить безопасность своего кошелька (и какие из них действительно стоит использовать)

- Малоизвестные инвестиционные стратегии, используемые профессионалами

- Как начать инвестировать в криптовалюту (какие биржи использовать, какую криптовалюту лучше купить и т.д.)