Funcionários alegam que a OpenAI e o Google DeepMind estão ocultando riscos da IA

- Ex-funcionários acusam empresas de IA de ocultar riscos que poderiam desencadear a extinção da humanidade.

- Dizem que as empresas priorizam o lucro em detrimento de uma "supervisão eficaz"

- Os denunciantes são desencorajados pela ameaça de represálias por parte dos empregadores.

Diversos funcionários atuais e antigos da OpenAI e do Google DeepMind acusaram suas empresas de ocultar riscos da IA que poderiam potencialmente levar à extinção da humanidade. Em uma carta aberta, os trabalhadores alegaram que as empresas de IA priorizam o lucro em detrimento de uma “supervisão [governamental] eficaz”

Leia também: OpenAI prepara sucessor para o GPT-4 em meio a preocupações com a segurança

A carta aberta foi assinada por 11 ex-funcionários da OpenAI, dois do Google DeepMind e endossada pelo "padrinho da IA", Geoffrey Hinton, ex-funcionário do Google. Nela, afirma-se que a busca pelo lucro e as brechas regulatórias permitem que as empresas encubram as ameaças representadas pela inteligência artificial avançada.

A IA pode levar à 'extinção da humanidade'

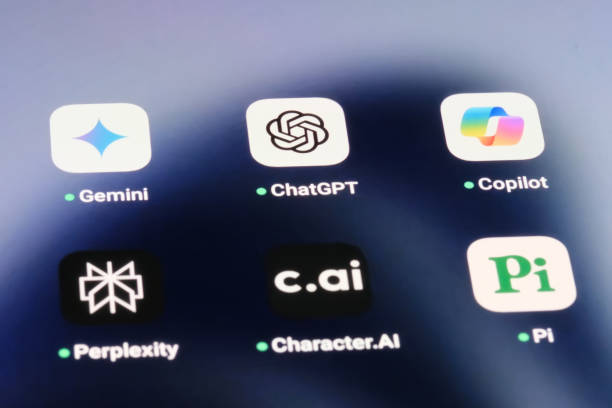

Segundo a carta, empresas de IA como a OpenAI e o Google DeepMind, criador do Gemini, não divulgaram publicamente informações sobre as salvaguardas inadequadas e os níveis de risco de seus sistemas porque não são obrigadas a fazê-lo.

Sem supervisão regulatória, os programas de IA podem causar grandes danos aos seres humanos. Os funcionários alertaram:

“Esses riscos variam desde o aprofundamento das desigualdades existentes… até a perda de controle de sistemas autônomos de IA, o que pode resultar na extinção da humanidade.”

Conforme observado pelos signatários da carta, as próprias empresas de IA reconheceram esses riscos. Em maio de 2023, os CEOs da OpenAI, Anthropic e Google DeepMind assinaram conjuntamente uma carta aberta do Center for AI Safety. A carta dizia simplesmente: “Mitigar o risco de extinção causado pela IA deve ser uma prioridade global, juntamente com outros riscos em escala social, como pandemias e guerra nuclear.”

As empresas de IA têm sido cada vez mais criticadas por priorizarem produtos inovadores e lucro em detrimento da segurança. do ChatGPT,tomou nota das preocupações levantadas na carta e afirmou estar trabalhando no desenvolvimento de inteligência artificial segura.

“Estamos orgulhosos do nosso tracde fornecimento dos sistemas de IA mais capazes e seguros e acreditamos na nossa abordagem científica para lidar com os riscos”, disse ao New York Times.

“Concordamos que um debate rigoroso é crucial, dada a importância desta tecnologia, e continuaremos a dialogar com governos, sociedade civil e outras comunidades em todo o mundo.”

Denunciantes temem represálias

Os ex-funcionários da OpenAI e do Google disseram que gostariam de ocupar o cargo de supervisão enquanto os órgãos reguladores elaboram leis que obriguem os desenvolvedores de IA a divulgar publicamente mais informações sobre seus programas.

No entanto, acordosdente a probabilidade de represálias por parte dos empregadores desencorajam os trabalhadores a expressarem publicamente suas preocupações. Conforme a carta:

“Alguns de nós temem, com razão, várias formas de retaliação, dada a história de casos semelhantes em todo o setor. Não somos os primeiros a enfrentar ou a falar sobre esses problemas.”

Nos Estados Unidos, os denunciantes são protegidos por lei, mas aqueles que denunciam os perigos da inteligência artificial não são amparados, pois a tecnologia ainda não é regulamentada.

Leia também: ChatGPT ainda espalha informações falsas, afirma órgão de proteção de dados da UE

A carta pedia às empresas de IA que facilitassem o feedback anônimo e verificável, apoiassem uma cultura de crítica aberta e não retaliassem contra denunciantes.

O pesquisador de IA Lance B. Eliot afirmou que as empresas adotam uma abordagem de incentivo e punição em relação às críticas. Funcionários que não se manifestam contra riscos são recompensados com promoções e aumentos salariais.

Por outro lado, denunciantes e críticos perdem suas opções de ações e podem ser forçados a sair da empresa e silenciosamente colocados em listas negras pela liderança da área de IA.

Reportagem Cryptopolitan por Jeffrey Gogo

Se você está lendo isto, já está um passo à frente. Continue assim assinando nossa newsletter.

Aviso Legal. As informações fornecidas não constituem aconselhamento de investimento. CryptopolitanO não se responsabiliza por quaisquer investimentos realizados com base nas informações fornecidas nesta página. Recomendamostrondentdentdentdentdentdentdentdent /ou a consulta a um profissional qualificado antes de tomar qualquer decisão de investimento.

CURSO

- Quais criptomoedas podem te fazer ganhar dinheiro?

- Como aumentar a segurança da sua carteira digital (e quais realmente valem a pena usar)

- Estratégias de investimento pouco conhecidas que os profissionais utilizam

- Como começar a investir em criptomoedas (quais corretoras usar, as melhores criptomoedas para comprar etc.)