Los empleados afirman que OpenAI y Google DeepMind ocultan los riesgos de la IA

- Ex empleados acusan a las empresas de inteligencia artificial de ocultar riesgos que podrían desencadenar la extinción humana.

- Dicen que las empresas priorizan las ganancias y evitan una “supervisión efectiva”

- Los denunciantes se sienten desanimados por la amenaza de represalias por parte de los empleadores.

Varios empleados y exempleados de OpenAI y Google DeepMind acusaron a sus empresas de ocultar riesgos de la IA que podrían provocar la extinción humana. En una carta abierta, los trabajadores alegaron que las empresas de IA priorizan las ganancias mientras evitan una supervisión gubernamental efectiva

Lea también: OpenAI prepara un sucesor para GPT-4 en medio de preocupaciones de seguridad

La carta abierta fue firmada por 11 exempleados de OpenAI, dos de Google DeepMind y respaldada por Geoffrey Hinton, y antiguo empleado de Google. En ella se afirma que los afáns de lucro y las lagunas regulatorias permiten a las empresas encubrir las amenazas que plantea la inteligencia artificial avanzada.

La IA podría conducir a la «extinción humana»

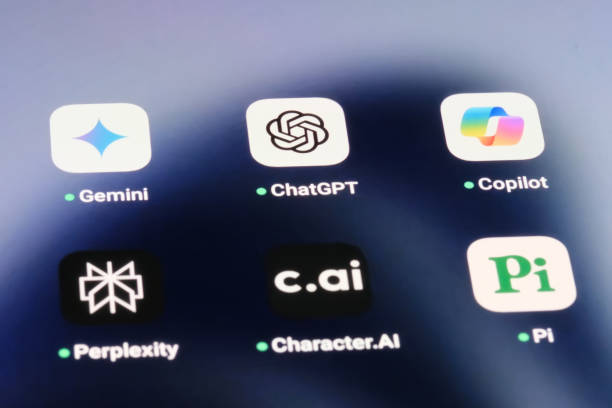

Según la carta, empresas de IA como OpenAI y Google DeepMind, creador de Gemini, no han compartido públicamente información sobre las protecciones inadecuadas y los niveles de riesgo de sus sistemas porque no están obligadas a hacerlo.

Sin supervisión regulatoria, los programas de IA podrían causar graves daños a los humanos. Los empleados advirtieron:

“Estos riesgos van desde una mayor profundización de las desigualdades existentes… hasta la pérdida de control de los sistemas autónomos de IA, que podría resultar en la extinción humana”

Como señalan los firmantes de la carta, las propias empresas de IA han reconocido estos riesgos. En mayo de 2023, los directores ejecutivos de OpenAI, Anthropic y Google DeepMind firmaron conjuntamente una carta abierta del Centro para la Seguridad de la IA. La carta decía simplemente: «Mitigar el riesgo de extinción provocado por la IA debería ser una prioridad global, junto con otros riesgos a escala social, como las pandemias y la guerra nuclear».

Las empresas de IA han sido objeto de un creciente escrutinio por priorizar productos novedosos y beneficios por encima de la seguridad. ChatGPT,señaló las preocupaciones planteadas en la carta y afirmó que está trabajando para desarrollar una inteligencia artificial segura.

“Estamos orgullosos de nuestra tracen el suministro de los sistemas de IA más capaces y seguros, y creemos en nuestro enfoque científico para abordar los riesgos”, declaró al New York Times.

“Estamos de acuerdo en que es fundamental mantener un debate riguroso dada la importancia de esta tecnología, y seguiremos colaborando con los gobiernos, la sociedad civil y otras comunidades de todo el mundo”

Los denunciantes temen represalias

Los ex empleados de OpenAI y Google dijeron que les gustaría desempeñar el papel de supervisión mientras los reguladores elaboran leyes que obliguen a los desarrolladores de IA a revelar públicamente más información sobre sus programas.

Sin embargo, los acuerdos dedenty la probabilidad de represalias por parte de los empleadores disuaden a los trabajadores de expresar públicamente sus preocupaciones. Según la carta:

Algunos de nosotros tememos con razón diversas formas de represalia, dado el historial de casos similares en toda la industria. No somos los primeros en encontrarnos con estos problemas ni en hablar de ellos

Los denunciantes están protegidos por ley en Estados Unidos, pero quienes hablan sobre los peligros de la inteligencia artificial no están cubiertos porque la tecnología aún no está regulada.

Lea también: ChatGPT sigue difundiendo falsedades, afirma el organismo de control de datos de la UE

La carta instaba a las empresas de inteligencia artificial a facilitar la retroalimentación anónima y verificable, apoyar una cultura de crítica abierta y no tomar represalias contra los denunciantes.

El investigador de inteligencia artificial Lance B. Eliot afirmó que las empresas adoptan un enfoque de incentivos y castigos ante las críticas. Los empleados que no denuncian los riesgos son recompensados con ascensos y aumentos salariales.

Por otro lado, los denunciantes y críticos pierden sus opciones sobre acciones y pueden ser obligados a abandonar la empresa y puestos en una lista negra silenciosa por la comunidad de líderes de IA.

Informes Cryptopolitan de Jeffrey Gogo

Si estás leyendo esto, ya llevas ventaja. Mantente al día con nuestro boletín informativo.

Descargo de responsabilidad. La información proporcionada no constituye asesoramiento financiero. Cryptopolitande no se responsabiliza de las inversiones realizadas con base en la información de esta página. Recomendamostrondentdentdentdentdentdentdentdent inversión.

CURSO

- ¿Qué criptomonedas pueden hacerte ganar dinero?

- Cómo mejorar tu seguridad con una billetera (y cuáles realmente vale la pena usar)

- Estrategias de inversión poco conocidas que utilizan los profesionales

- Cómo empezar a invertir en criptomonedas (qué plataformas de intercambio usar, las mejores criptomonedas para comprar, etc.)