- OpenAI 推出了一项安全计划,赋予其董事会对高风险人工智能开发项目的否决权。.

- 《准备框架》概述了评估和减轻与强大的人工智能模型相关的灾难性风险的流程。.

- OpenAI 建立了安全团队、超级协调团队和准备团队,以监控和评估不同的 AI 风险类别。.

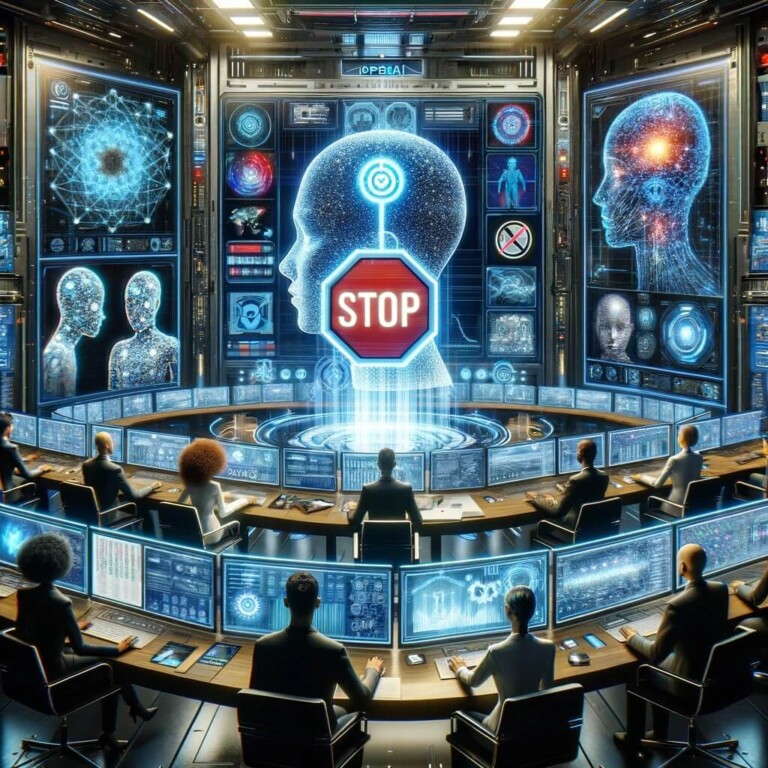

OpenAI 近日推出一项新的安全举措,赋予其董事会权力,在认为人工智能开发相关风险过高时,可否决首席执行官 Sam Altman 的决定。这项名为“准备框架”的综合战略旨在弥补目前在研究前沿人工智能风险方面的不足,并系统化安全协议。该框架详细阐述了 OpenAI 如何监控、评估、预测和防范日益强大的人工智能模型带来的灾难性风险。.

高风险人工智能开发框架

在这项大胆的计划下,OpenAI 将成立专门团队,负责监管人工智能开发风险的各个方面。安全系统团队将专注于潜在的滥用行为以及与现有人工智能模型(例如 ChatGPT)相关的风险。与此同时,准备团队将审查前沿模型,而专门的超级对齐团队将密切监控超级智能模型的开发。所有这些团队都将在董事会的监督下运作。.

随着 OpenAI 致力于打造超越人类智能的人工智能,该公司强调必须预见未来的挑战。新模型将接受严格测试,被推向“极限”,并随后从四个风险类别进行评估:网络安全、说服力(谎言和虚假信息)、模型自主性(自主决策)以及 CBRN(化学、生物、放射性和核威胁)。每个类别都将被赋予一个风险评分——低、中、高或危——以及一个缓解措施后的评分。如果风险为中等或以下,则继续部署;如果风险为高,则在采取预防措施的情况下继续部署;如果风险被判定为危,则停止部署。OpenAI 还承诺采取问责措施,并在出现问题时引入dent 第三方进行审计。.

OpenAI 的 AI 安全方法及其未来影响

OpenAI 极其重视促进广泛的合作,不仅包括外部合作,也包括其内部错综复杂的团队网络,尤其是安全系统团队。这种协作协同作用被积极引导至严密的监控和缓解措施,旨在防范现实世界中的滥用行为。为了进一步拓展这种协作精神,OpenAI 将其合作努力无缝延伸至超对齐领域,在该领域,其战略重点在于精准dent并应对与错位相关的突发风险。.

OpenAI始终致力于拓展知识的边界,在开拓新的研究领域中扮演着先锋角色。在对创新孜孜不倦的追求中,其重点在于深入探索风险演变与模型指数级扩展之间微妙的动态关系。这项学术探索的总体目标雄心勃勃——提前预测风险。为了实现这一宏伟目标,OpenAI战略性地利用了以往成功经验,特别是那些基于对扩展规律的遵循而取得的成就。.

领域迈出里程碑式的一步 人工智能安全,允许董事会否决 CEO 的决定所带来的影响也引发了诸多疑问。这项决定能否在创新与谨慎之间取得恰当的平衡?“准备框架”在预测和降低开发高级人工智能模型相关风险方面究竟能发挥多大作用?OpenAI 的这一大胆举措究竟是会使其成为负责任的人工智能开发领域的先驱,还是会引发关于人工智能领域权威与创新交汇点的争论,一切都尚待时间检验。

如果你正在阅读这篇文章,你已经领先一步了。 订阅我们的新闻简报,继续保持领先优势。

免责声明: 提供的信息并非交易建议。Cryptopolitan.com Cryptopolitan研究 对任何基于本页面信息进行的投资概不负责。我们trondentdentdentdentdentdentdentdent /或咨询合格的专业人士。

学速成课程

- 哪些加密货币可以让你赚钱

- 如何通过钱包提升安全性(以及哪些钱包真正值得使用)

- 专业人士使用的鲜为人知的投资策略

- 如何开始投资加密货币(使用哪些交易所、购买哪种加密货币最划算等)