员工声称 OpenAI 和 Google DeepMind 隐瞒了人工智能风险

- 前员工指责人工智能公司隐瞒可能导致人类灭绝的风险。.

- 他们说,企业把利润放在第一位,同时逃避“有效监管”。

- 雇主的报复威胁会让举报人望而却步。.

OpenAI 和 Google DeepMind 的多位现任及前任员工指责公司隐瞒人工智能可能导致人类灭绝的风险。在一封公开信中,这些员工声称人工智能公司将利润置于首位,同时逃避“有效的(政府)监管”。

另请阅读: OpenAI在安全隐患中筹备GPT-4继任者

这封 公开信 由11位OpenAI前员工、两位谷歌DeepMind前员工联署,并得到了“人工智能教父” 、前谷歌员工杰弗里·辛顿 。信中指出,逐利动机和监管漏洞使得企业得以掩盖先进人工智能带来的威胁。

人工智能可能导致“人类灭绝”

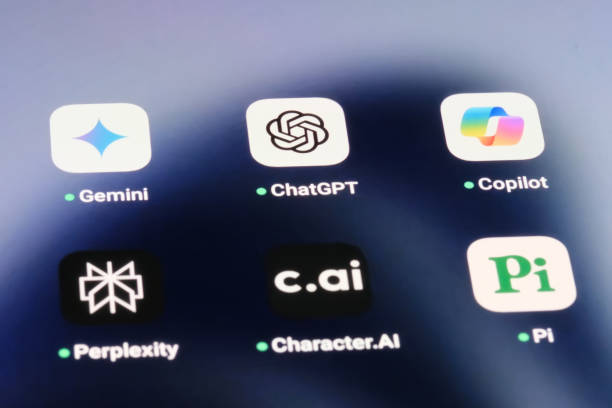

信中指出,OpenAI 和 Gemini没有公开分享有关其系统安全措施不足和风险级别的信息,因为它们没有义务这样做。

如果没有监管,人工智能程序可能会对人类造成重大伤害。员工们警告说:

“这些风险包括进一步加剧现有的不平等现象……以及失去对自主人工智能系统的控制,这可能导致人类灭绝。”

正如这封信的签署者所指出的,人工智能公司自身也承认了这些风险。2023年5月,OpenAI、Anthropic和谷歌DeepMind的首席执行官 共同签署了 人工智能安全中心的一封公开信。信中写道:“降低人工智能导致人类灭绝的风险,应该与应对其他社会层面的风险(例如流行病和核战争)一样,成为全球优先事项。”

而日益受到 审查 因将创新产品和利润置于安全之上 的开发商 OpenAI 注意到了信中提出的担忧,并表示正在努力开发安全的人工智能。

“我们为我们提供最强大、最安全的 AI 系统的记录感到自豪 trac并且相信我们应对风险的科学方法。” 告诉 《纽约时报》:

“我们一致认为,鉴于这项技术的重要性,进行严谨的辩论至关重要,我们将继续与世界各地的政府、民间社会和其他社区进行交流。”

举报人担心遭到报复

这些前 OpenAI 和谷歌员工表示,他们希望在监管机构制定法律强制人工智能开发者公开披露更多关于其程序的信息期间,担任监督角色。.

然而,dent协议以及雇主可能进行的报复,使得员工不愿公开表达自己的担忧。信中指出:

“鉴于业内此类事件的过往历史,我们中的一些人有理由担心遭到各种形式的报复。我们并非第一个遇到或谈论这些问题的人。”

在美国,举报人受到法律保护,但那些公开谈论人工智能危险的人却不受保护,因为这项技术尚未受到监管。.

另请阅读: 欧盟数据监管机构称 ChatGPT 仍在散布虚假信息

这封信呼吁人工智能公司提供可验证的匿名反馈,支持公开批评的文化,并且不要对举报人进行报复。.

人工智能研究员兰斯·B·艾略特 表示, 企业对批评采取胡萝卜加大棒的策略。不公开批评风险的员工会获得晋升和加薪等奖励。

另一方面,举报人和批评者会失去股票期权,并可能被迫离开公司,还会被人工智能领导层悄悄列入黑名单。.

杰弗里·戈戈的Cryptopolitan 报道

如果你正在阅读这篇文章,你已经领先一步了。 订阅我们的新闻简报,继续保持领先优势。

免责声明: 提供的信息并非交易建议。Cryptopolitan.com Cryptopolitan研究 对任何基于本页面信息进行的投资概不负责。我们trondentdentdentdentdentdentdentdent /或咨询合格的专业人士。

学速成课程

- 哪些加密货币可以让你赚钱

- 如何通过钱包提升安全性(以及哪些钱包真正值得使用)

- 专业人士使用的鲜为人知的投资策略

- 如何开始投资加密货币(使用哪些交易所、购买哪种加密货币最划算等)