Anthropico首席执行官表示,未来三年人工智能训练成本可能高达1000亿美元。

- 未来几年,人工智能训练成本预计将大幅上涨。

- 像 ChatGPT-4 这样的高级人工智能模型,训练费用大约需要 1 亿美元。

- 领先的科技公司正在人工智能的研发领域投入巨资。

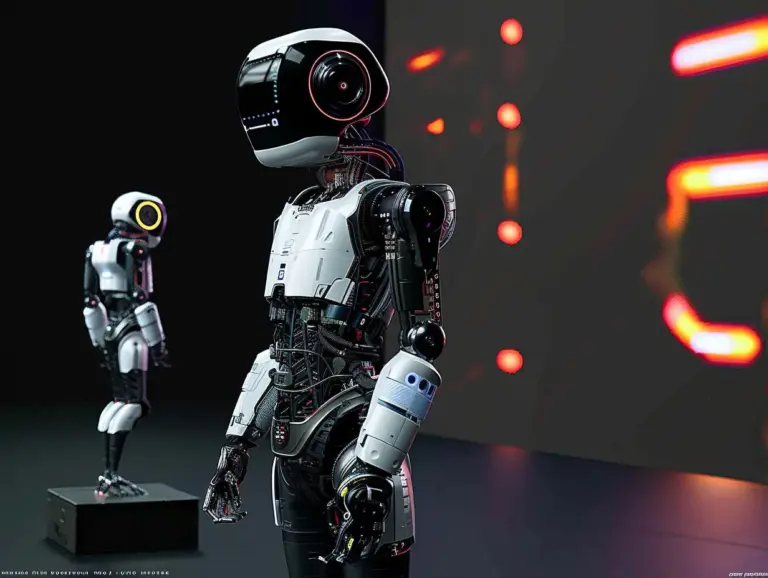

人工智能(AI)模型的训练成本正在飞速上涨,预计未来几年还将显著增长。人工智能初创公司Anthropic的首席执行官Dario Amodei在最近一期“In Good Company”播客节目中重点谈到了这些不断上涨的成本。

另请阅读: 三星员工因人工智能竞争加剧而罢工,要求提高工资

目前先进的人工智能模型,例如 ChatGPT-4,训练费用约为 1 亿美元。但 据 Amodei 称,未来三年内,这一数字可能会飙升至 100 亿至 1000 亿美元。

通用人工智能的开发推高了成本。

这一迅猛发展源于人工智能技术从生成式人工智能(例如 ChatGPT)向通用人工智能(AGI)的转变。AGI 的发展目标是开发能够像人脑一样理解、获取和利用知识的系统。

“我认为,如果我们能达到 100 亿美元或 1000 亿美元,我认为这会在 2025 年、2026 年,或许 2027 年实现……那么我认为,到那时,我们很有可能能够获得在大多数方面都比大多数人类更优秀的模型。”

阿莫迪

据 Tom's Hardware 报道,目前这些技术进步所需的现有框架规模庞大。例如,训练 ChatGPT 需要超过 3 万个 GPU,而每颗英伟达 B200 AI 芯片的成本在 3 万到 4 万美元之间。这种硬件投资可能是导致成本增加的因素之一。

计算资源推高了人工智能训练成本。

人工智能训练成本不断攀升的原因有很多。最主要的原因是所需的计算资源极其庞大。随着深度学习模型的进步,需要功能强大的GPU和其他专用硬件。2023年,超过380万块GPU被运往数据中心,这足以说明所需基础设施的规模之大。

另一个重要因素是能源消耗。去年售出的所有GPU的耗电量足以供130万户家庭使用。如此高的能耗不仅导致企业成本高昂,也引发了环境影响和环境保护方面的担忧。根据谷歌最近的一份报告,该公司四年来的碳排放量增长了近50%,主要原因是人工智能学习所需的能源。

科技巨头在人工智能基础设施方面投入巨资

此外,领先的科技公司正在大力投资人工智能的研发。例如,埃隆·马斯克计划购买英伟达30万颗最先进的人工智能芯片。同样,微软和OpenAI据称正在合作建设一个价值1000亿美元的数据中心,以推动人工智能的发展。

另请阅读: 温布尔登网球公开赛运用人工智能打击网络暴力

尽管成本不断攀升,但人们仍在尝试优化人工智能训练的成本。谷歌旗下的DeepMind最近提出了一种名为联合样本选择(JEST)的技术,该技术声称可以将迭代次数减少13倍,并将所需的计算资源减少10倍。这有助于减少资源消耗和训练时间。

然而,即便取得了这些进展,由于通用人工智能(AGI)的不断发展,总体趋势仍然是成本上升。从生成式人工智能到通用人工智能,模型都需要能够解读大型数据集、从中学习、预测不同情况并解决需要批判性思维的问题。

布伦达·卡纳纳 (Brenda Kanana) 的Cryptopolitan 报告

不要只是阅读加密货币新闻,要理解它。订阅我们的新闻简报, 完全免费。

免责声明: 提供的信息并非交易建议。Cryptopolitan.com Cryptopolitan研究 对任何基于本页面信息进行的投资概不负责。我们tron您在做出任何投资决定前进行独立dent /或咨询合格的专业人士。

布伦达·卡纳纳

Brenda拥有超过4年的加密货币、人工智能和新兴技术领域的专业经验。她曾就职于Zycrypto、Blockchain Reporter和The Coin Republic,现在在 Cryptopolitan 工作。她拥有蒙巴萨理工大学的社会学学位,这使她能够敏锐地把握读者的脉搏。.

学速成课程

- 哪些加密货币可以让你赚钱

- 如何通过钱包提升安全性(以及哪些钱包真正值得使用)

- 专业人士使用的鲜为人知的投资策略

- 如何开始投资加密货币(使用哪些交易所、购买哪种加密货币最划算等)