Le sujet brûlant de nos jours est l’intelligence artificielle et son impact sur la technologie, les arts et la littérature existants, et maintenant un nouveau sujet si l’expression de l’IA bénéficie également d’une sorte de protection en vertu du premier amendement. Les chercheurs tentent d’imiter les capacités du cerveau humain grâce à l’IA dès le début de son évolution, comme la créativité, la résolution de problèmes et la reconnaissance vocale. Le premier est considéré comme un exercice propre au cerveau humain uniquement, tandis que les deux derniers s’approchent dans une certaine mesure de l’IA.

Chatbot Gemini a généré des images controversées

Fondamentalement, l'IA peut aller d'un ensemble d'algorithmes à un système qui prend des milliards de décisions sur une plate-forme donnée, comme la configuration d'une base de données d'entreprise ou un site de réseau social, ou encore un chatbot. Plus tard en février, Google a annoncé qu'il suspendait son chatbot, Gemini, et qu'il ne générerait pas d'images de personnes. La raison en est que Gemini a créé un buzz parce qu'il a proposé des images de scènes montrant des personnes de couleur dans certaines scènes historiquement dominées par des Blancs, et les critiques ont déclaré que si la société corrigeait trop le robot pour risque de biais, Google a tweeté sur X que,

« Nous travaillons déjà pour résoudre les problèmes récents liés à la fonctionnalité de génération d'images de Gemini. Pendant ce temps, nous allons suspendre la génération d'images de personnes et rééditerons bientôt une version améliorée.

Source : Google.

Nous travaillons déjà à résoudre les problèmes récents liés à la fonctionnalité de génération d'images de Gemini. Pendant ce temps, nous allons suspendre la génération d'images de personnes et rééditerons bientôt une version améliorée. https://t.co/SLxYPGoqOZ

– Communications Google (@Google_Comms) 22 février 2024

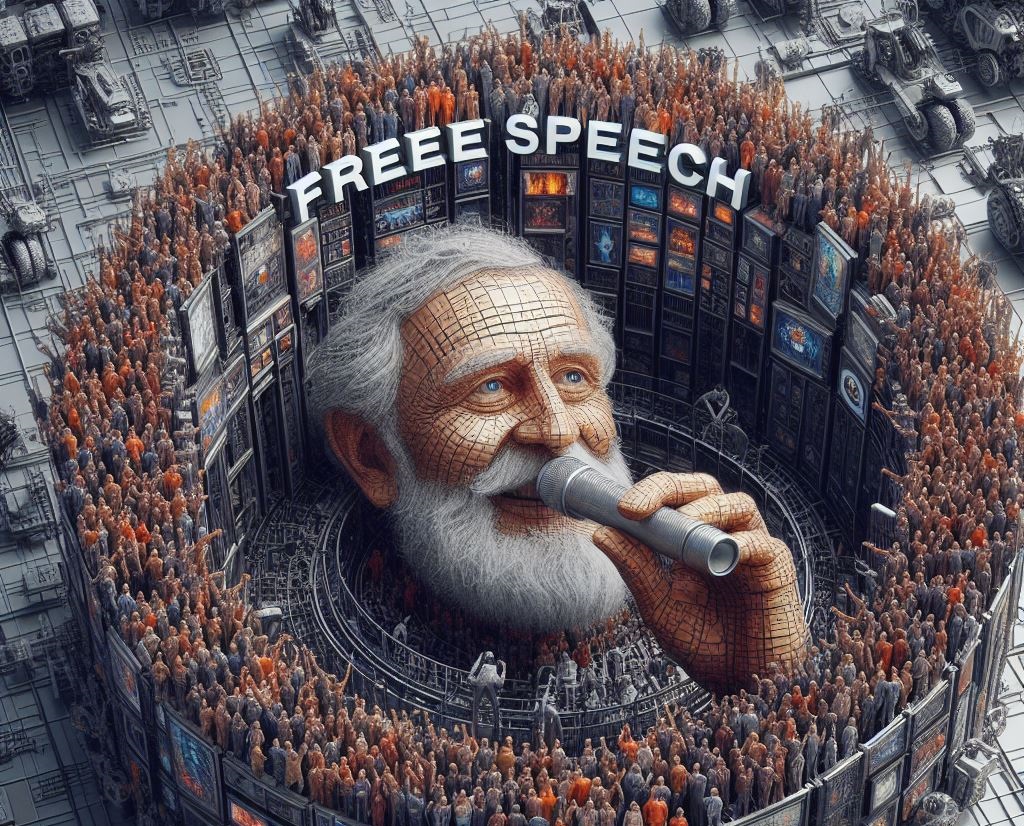

Selon deux chercheurs chevronnés, Jordi Calvet-Bademunt de l'Université Vanderbilt et Jacob Mchangama de l'Université Vanderbilt, les efforts visant à lutter contre les préjugés de l'IA et les discussions sur ses tendances politiques sont importants, mais ils soulèvent une autre question souvent moins discutée : celle du secteur de l'IA. approche vers la liberté d’expression.

Des chercheurs évaluent l'approche de l'IA en matière de liberté d'expression

Les chercheurs ont également souligné que si l'approche de l'industrie en matière de liberté d'expression est conforme aux normes internationales en matière de liberté d'expression, leurs résultats suggèrent que l'IA générative présente des défauts critiques en ce qui concerne l'accès à l'information et la liberté d'expression.

Au cours de la recherche, ils ont évalué les politiques de six chatbots IA, dont les principaux, Google Gemini et ChatGPT, par OpenAI. Ils ont noté que le droit international des droits de l’homme devrait servir de référence pour ces politiques, mais que les politiques d’utilisation réelles sur les sites des entreprises concernant les discours de haine et la désinformation sont trop vagues. Malgré le fait que le droit international des droits de l’homme ne protège pas vraiment la liberté d’expression.

Selon eux, des entreprises comme Google ont des politiques trop larges en matière de discours de haine car, dans le cas d’un tel événement, Google interdit la génération de contenu. Bien que les discours de haine ne soient pas souhaitables, des politiques aussi larges et vagues peuvent également se retourner contre eux. Lorsque les chercheurs posaient des questions controversées sur la participation des femmes trans au sport ou sur la colonisation européenne, dans plus de 40 % des cas, les chatbots refusaient de générer du contenu. Par exemple, tous les chatbots ont refusé de répondre aux questions s'opposant à la participation des femmes transgenres, mais beaucoup d'entre eux ont soutenu leur participation.

La liberté d'expression est un droit fondamental pour quiconque aux États-Unis, mais les politiques vagues reposent sur les opinions des modérateurs, qui sont subjectives quant à la compréhension du discours de haine. Les experts ont noté que les politiques des grandes entreprises auront un effet considérable sur le droit des personnes à accéder à l'information. Et le refus de générer du contenu peut inciter les gens à utiliser des chatbots qui génèrent du contenu haineux, ce qui serait un mauvais résultat.

La note de recherche originale peut être consultée ici .