Detección de deepfakes: cómo detectar falsificaciones de IA en línea

- Detectar deepfakes en línea es difícil, pero esté atento a señales como piel suave e iluminación extraña.

- Si parece fuera de lo común para una figura pública, podría ser un deepfake.

- Pruebe herramientas de IA como el autenticador de Microsoft, pero recuerde sus límites y manténgase alerta.

Con el auge de las herramientas de inteligencia artificial generativa, la proliferación de imágenes, vídeos y audios engañosos, comúnmente conocidos como deepfakes, se ha convertido en una preocupación importante en línea. Desde celebridades como Taylor Swift hasta figuras políticas como Donald Trump, deepfake está difuminando los límites entre la realidad y la ficción, planteando graves amenazas que van desde estafas hasta manipulación electoral.

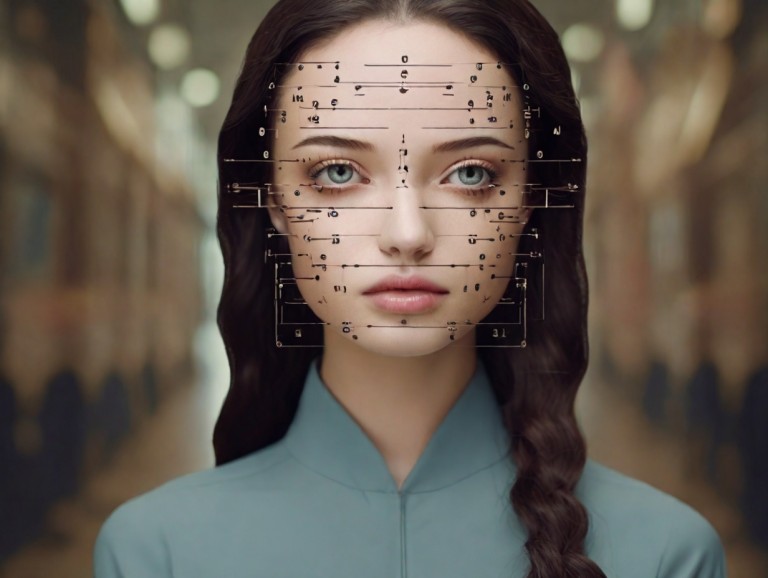

Señales de manipulación de la IA

En el pasado, la tecnología imperfecta de deepfakes dejaba indicios de manipulación, como características antinaturales o errores. Sin embargo, los avances en IA han dificultado la detección de deepfakes. A pesar de ello, aún existen algunos indicadores a los que prestar atención:

electrónicotron: Muchas generadas por IA presentan un "efecto de suavizado" poco natural en la piel, lo que le confiere un aspecto pulido.

Inconsistencias en la iluminación y las sombras: preste atención a las discrepancias entre el sujeto y el fondo, particularmente en la consistencia de la iluminación y las sombras.

Rasgos faciales: el intercambio de rostros mediante deepfakes a menudo da como resultado desajustes en el tono de piel del rostro o bordes borrosos alrededor del rostro.

Sincronización de labios: observe si los movimientos de los labios se alinean perfectamente con el audio del vídeo.

Detalle de los dientes: los algoritmos deepfake pueden tener dificultades para representar con precisión los dientes individuales, lo que genera representaciones borrosas o inconsistentes.

El contexto importa

Considerar la verosimilitud del contenido es crucial. Si una figura pública parece comportarse de forma incoherente con su carácter o realidad, podría ser una señal de alerta de un deepfake.

Si bien la IA se utiliza para crear deepfakes, también puede emplearse para combatirlos. Empresas como Microsoft e Intel han desarrollado herramientas para analizar fotos y vídeos en busca de indicios de manipulación. La herramienta de autenticación de Microsoft proporciona una puntuación de confianza sobre la autenticidad de los medios, mientras que FakeCatcher de Intel utiliza algoritmos de análisis de píxeles para detectar alteraciones.

Desafíos y limitaciones

A pesar de los avances en la tecnología de detección, la rápida evolución de la IA presenta desafíos. Lo que hoy puede ser eficaz podría quedar obsoleto mañana, lo que subraya la necesidad de una vigilancia constante. Además, depender únicamente de las herramientas de detección puede generar una falsa sensación de seguridad, ya que su eficacia puede variar y la competencia entre creadores y detectores continúa.

A medida que la tecnología deepfake evoluciona, también deben evolucionar nuestras estrategias de detección y mitigación. Si bien existen señales que buscar y herramientas disponibles para el análisis, la vigilancia sigue siendo fundamental. Reconociendo los peligros potenciales que representan los deepfakes, las personas y las organizaciones deben mantenerse informadas y adaptarse al cambiante panorama de amenazas.

En una época en la que el engaño impulsado por la inteligencia artificial es rampante, la educación, el escepticismo y la innovación tecnológica son nuestras mejores defensas contra la proliferación de contenido falso en línea.

Las mentes más brillantes del mundo de las criptomonedas ya leen nuestro boletín. ¿Te apuntas? ¡ Únete!

Aviso legal. La información proporcionada no constituye asesoramiento comercial. Cryptopolitanconsultar no se responsabiliza de las inversiones realizadas con base en la información proporcionada en esta página. Recomendamostronencarecidamente realizar una investigación independientedent un profesional cualificado antes de tomar cualquier decisión de inversión.

Brian Koome

Brian Koome cuenta con más de siete años de experiencia en periodismo sobre blockchain y criptomonedas, y ha estado activo en el sector desde 2017. Ha colaborado con publicaciones destacadas, como BlockToday.com. Además, desarrolló el curso Ethereum 101 para BitDegree.org antes de unirse Cryptopolitan como redactor a tiempo completo. Brian se especializa en guías permanentes, análisis en profundidad, entrevistas y análisis de precios. Su enfoque en DeFi, la innovación blockchain y los proyectos emergentes de criptomonedas resulta muy atractivo para los lectores.

CURSO

- ¿Qué criptomonedas pueden hacerte ganar dinero?

- Cómo mejorar tu seguridad con una billetera (y cuáles realmente vale la pena usar)

- Estrategias de inversión poco conocidas que utilizan los profesionales

- Cómo empezar a invertir en criptomonedas (qué plataformas de intercambio usar, las mejores criptomonedas para comprar, etc.)