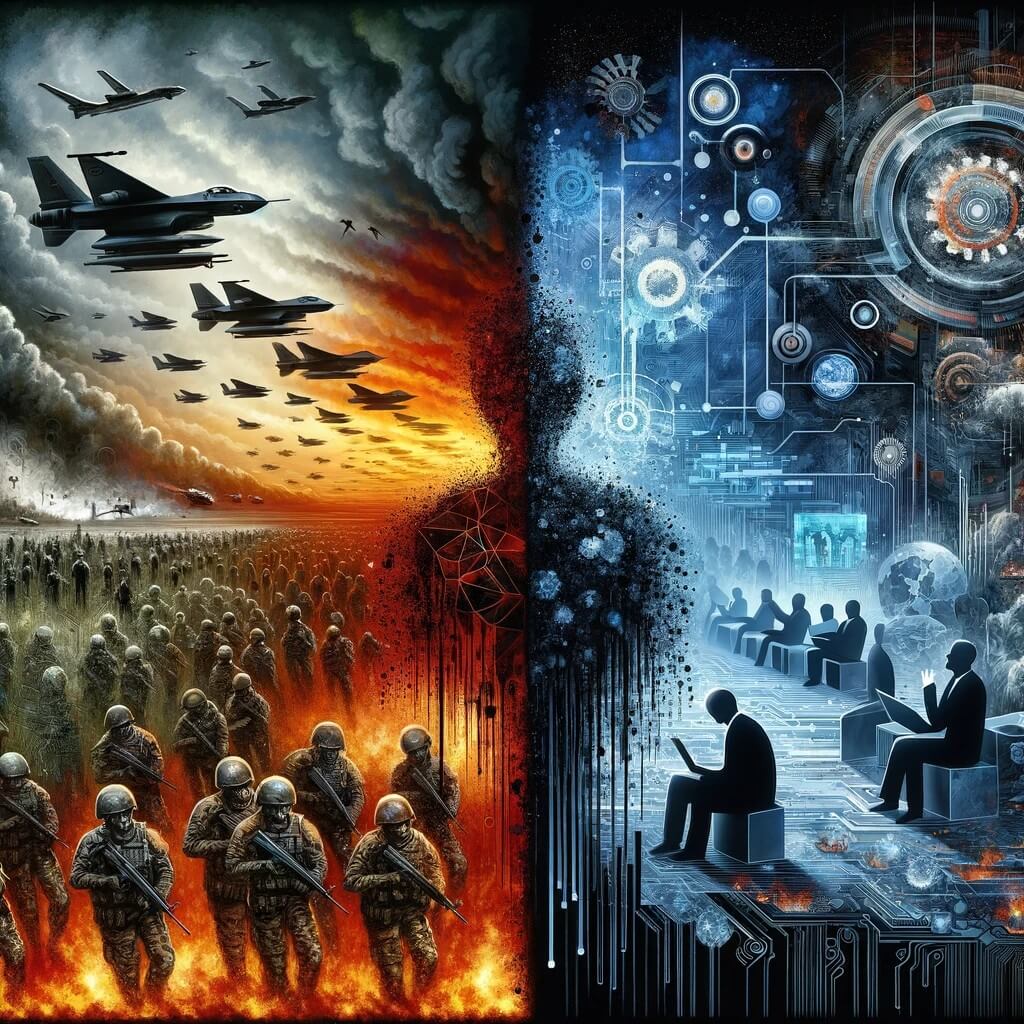

En una era donde el impacto de la inteligencia artificial (IA) en la guerra y la gobernanza corporativa cobra una gran importancia, la cuerda floja ética entre la innovación y la rendición de cuentas es más precaria que nunca. La integración de la IA en las operaciones militares ha llegado a un punto crítico.

Los conflictos recientes, en particular en Gaza, ponen de relieve el alarmante uso de la IA en decisiones cruciales. El programa de IA del ejército israelí, "El Evangelio", es un claro ejemplo. Acelera ladentde objetivos, sea correcta o no, lo que genera inquietudes éticas por el aumento de las bajas civiles, incluidos niños. Esta escalada en la guerra impulsada por la IA exige una reevaluación urgente de los límites éticos y los marcos regulatorios que rigen el uso de la IA en contextos militares.

Al mismo tiempo, la repentina destitución de Sam Altman como director ejecutivo de OpenAI desató una ola de preocupación con respecto a los procesos de supervisión y toma de decisiones dentro de una organización líder en la industria de la IA. Estedent reveló incertidumbres más profundas sobre las complejidades del desarrollo y la utilización de la IA, un tema que había permanecido bastante oculto incluso antes de que salieran a la luz estos desafíos internos.

A nivel mundial, los legisladores se enfrentan a la rápida evolución de la tecnología de IA. Su lucha por establecer regulaciones y mecanismos de supervisión esdent. El ritmo de la innovación en IA supera con creces el desarrollo de directrices legales y éticas. Esta brecha plantea riesgos significativos, no solo en aplicaciones militares, sino en diversos sectores donde la IA se está adoptando rápidamente.

El alarmante coste de la IA en vidas humanas en Gaza y la crisis de gobernanza de OpenAI

La implementación de la IA en el conflicto de Gaza pone de manifiesto una cruda realidad. Los sistemas de IA, carentes de empatía humana, están seleccionando objetivos. Las bajas civiles resultantes, incluyendo un número alarmante de niños, pintan un panorama desgarrador del posible uso indebido de la IA. Esta situación exige un análisis crítico del papel de la IA en la guerra, enfatizando la necesidad de estándares éticos estrictos y supervisión humana en las operaciones militares impulsadas por IA.

OpenAI, organización líder en investigación de IA, se enfrentó recientemente a importantes problemas de gobernanza. El despido inesperado del director ejecutivo, Sam Altman, ha suscitado debates sobre la transparencia y el control en el desarrollo de la IA. Estedent pone de relieve los desafíos más amplios que supone gobernar entidades poderosas de IA. La falta de claridad y rendición de cuentas en estas organizaciones supone un riesgo no solo para el desarrollo ético de la IA, sino también para la confianza pública en estas tecnologías.

Un notable defide conocimiento en los organismos gubernamentales sobre la IA agrava el desafío de la regulación. Esta brecha, sumada a las complejidades burocráticas y la preocupación por obstaculizar los beneficios de la IA, ha llevado a un enfoque laissez-faire en la gobernanza de la IA. En consecuencia, las empresas de IA, incluidas aquellas que desarrollan tecnologías potencialmente transformadoras, operan con una supervisión mínima. Este crecimiento descontrolado de la IA, especialmente en áreas sensibles como las aplicaciones militares, es una preocupación importante.

Lecciones de la guerra en Gaza: ¿deficiencias de la IA o mal uso deliberado por parte de Israel?

Los ejércitos de todo el mundo observan atentamente el uso despiadado de la IA en Gazanegativodent para futuros conflictos. ¿Contribuye la falta de ética de la IA a la preocupación mundial, o se trata del uso deliberado de la IA por parte de Israel para la destrucción masiva? Las lecciones aprendidas aquí podrían influir en el desarrollo y la implementación de la IA en otros contextos militares. Este escenario subraya la necesidad urgente de un diálogo internacional sobre el uso ético de la IA en la guerra, con especial atención a la prevención de bajas civiles y la garantía de la rendición de cuentas.

La situación en Gaza y los problemas de gobernanza en OpenAI marcan un punto de inflexión. Se alejan de la idea de que la IA conducirá inequívocamente a un mundo mejor. ¿Podrían las preocupaciones sobre el uso indebido de la IA, incluidas las posibles acciones deliberadas, alterar esta trayectoria? El potencial de la IA para ayudar a la humanidad a alcanzar objetivos sindentes innegable. Sin embargo, su desarrollo en secreto y su aplicación en situaciones de riesgo vital exigen un enfoque más crítico y ético. Una regulación y una supervisión eficaces son cruciales para garantizar el impacto positivo de la IA en la sociedad.

El futuro de la IA: un llamado a la innovación responsable

A medida que la IA continúa evolucionando, su impacto en la sociedad y la guerra se profundiza. El panorama regulatorio y ético actual va a la zaga de este rápido desarrollo. Los gobiernos y los organismos internacionales deben agilizar el establecimiento de marcos sólidos para regular la IA. Estos marcos deben priorizar las consideraciones éticas, la transparencia y la rendición de cuentas, especialmente en aplicaciones de alto riesgo como la guerra. Solo mediante la innovación responsable la IA puede beneficiar verdaderamente a la humanidad sin causar daños irreparables.

El doble papel de la IA como herramienta de progreso y posible instrumento de destrucción es ahora másdent que nunca. Losdenten Gaza y en OpenAI sirven como una llamada de atención. Ponen de relieve la necesidad de un enfoque equilibrado para el desarrollo de la IA, que reconozca sus beneficios y aborde críticamente sus riesgos. A medida que la IA continúa transformando nuestro mundo, es necesario un esfuerzo colectivo para aprovechar su potencial de forma responsable, garantizando que sirva al bien común sin comprometer los estándares éticos.