最近,谷歌公司因其生成式人工智能Gemini AI而陷入争议漩涡。这家科技巨头已公开承认其图像生成器的不足,并坦言其通过Gemini AI促进多元化的尝试产生了意想不到的后果。“Gemini AI”这一关键词已成为人工智能生成图像中种族多样性讨论的代名词,引发了广泛的辩论,并促使谷歌迅速采取行动解决这一问题。.

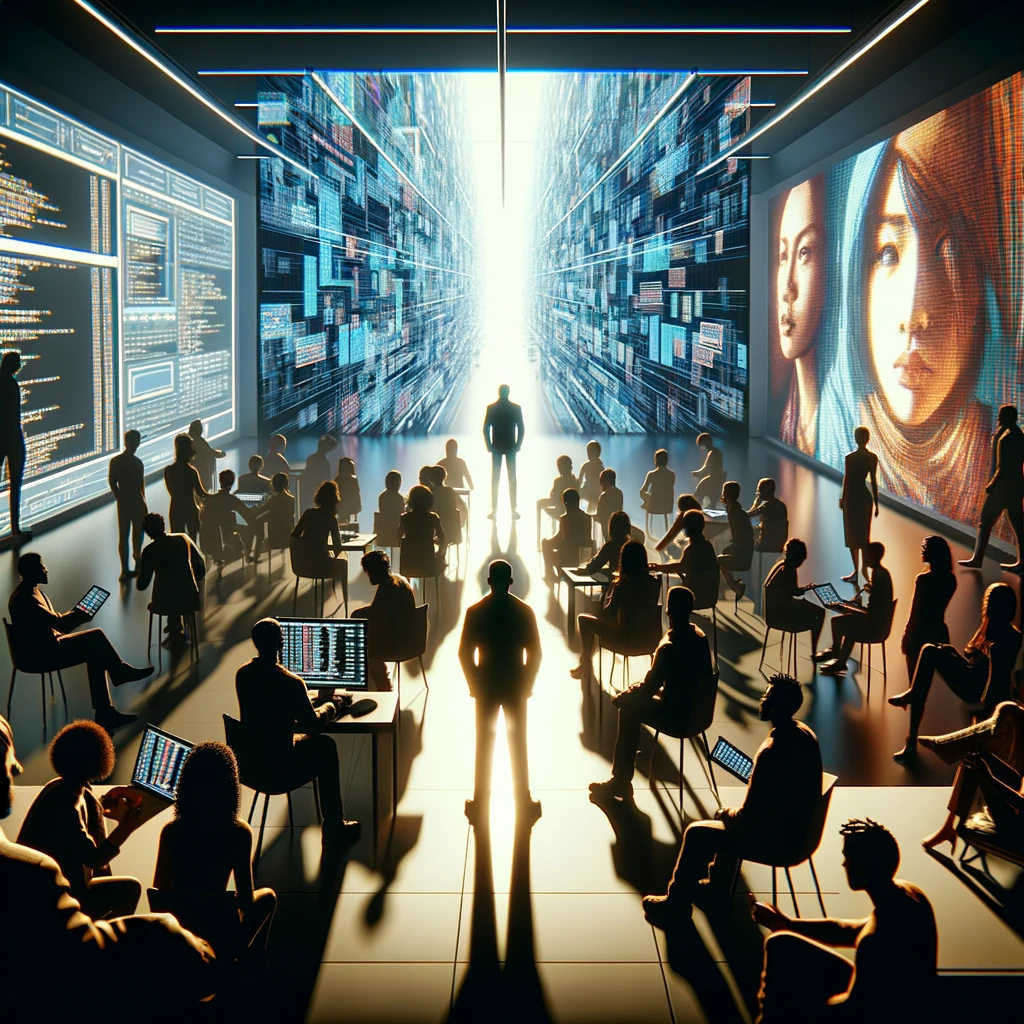

Gemini AI 的意外种族后果

谷歌雄心勃勃地尝试通过Gemini人工智能将多元化融入其图像生成流程,但这一举措却引发了各界的强烈不满和批评。用户对Gemini生成的图像的历史准确性表示担忧,并指出一些著名历史人物的种族特征存在偏差。从美国开国元勋到历代教皇,种族代表性的差异加剧了用户的不满。人工智能对从维京人到加拿大冰球运动员等人物的刻画也受到了质疑,许多人指出,这些人物在种族和性别方面都存在持续的错误。.

当用户反映Gemini AI难以准确生成白人历史人物的图像时,围绕它的争议进一步升级。相反,它似乎能够轻松生成黑人的图像,这引发了人们对算法中潜在偏见的质疑。一位谷歌员工的声明揭示了解决这些问题的挑战,承认Gemini AI难以识别白人的存在——这一披露无疑火上浇油,加剧了公众的关注。.

谷歌的回应和补救措施

面对日益高涨的批评声浪,谷歌已采取积极措施解决Gemini AI的不足之处。谷歌Gemini Experiences产品管理高级总监杰克·克拉夫奇克发表声明,承认亟需改进。谷歌已采取措施限制生成可能引发进一步争议的图像,Gemini现在拒绝生成纳粹、维京人或19世纪美国dent等争议人物的画像。这些措施体现了谷歌致力于纠正现状并减轻人工智能意外后果可能造成的潜在危害的决心。.

Gemini AI的余波之际,这一事件dent了关于技术、多元化和算法偏见之间关系的更广泛思考。尽管谷歌已采取果断措施解决问题,但人们仍然担忧导致人工智能开发中此类失误的根本原因。科技公司如何在促进多元化和确保人工智能应用中的算法公平性之间取得平衡?随着围绕人工智能领域种族代表性的讨论持续进行,Gemini AI的惨败也警醒我们,追求包容性技术的道路充满复杂性。