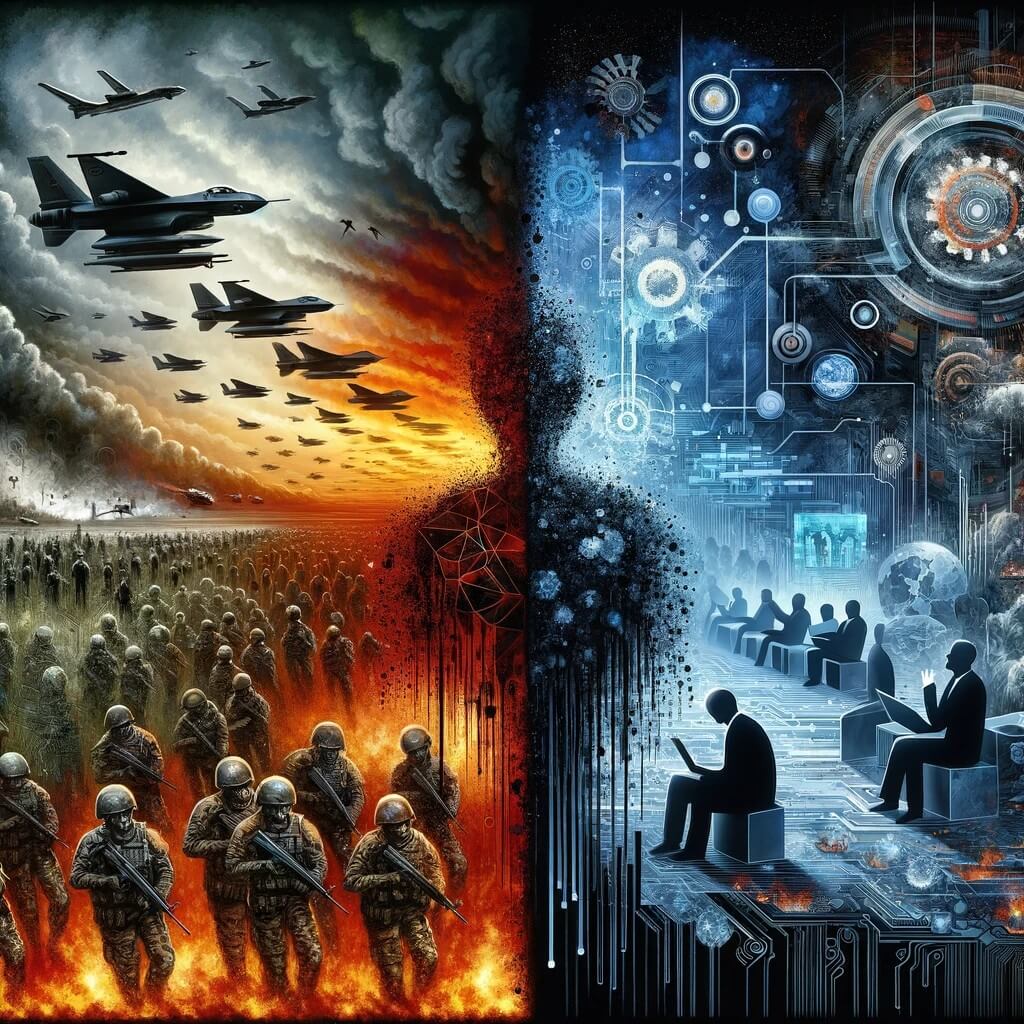

В эпоху, когда влияние искусственного интеллекта (ИИ) на военные действия и корпоративное управление становится всё более значительным, этическая грань между инновациями и ответственностью становится как никогда шаткой. Интеграция ИИ в военные операции достигла критического момента.

Недавние конфликты, особенно в секторе Газа, высвечивают тревожное использование ИИ в решениях, от которых зависит жизнь и смерть. Ярким примером служит израильская военная программа ИИ «Евангелие». Она ускоряетdentцелей, независимо от того, насколько она точна, что вызывает этические опасения по поводу увеличения числа жертв среди гражданского населения, включая детей. Эта эскалация войны с использованием ИИ требует срочной переоценки этических границ и нормативно-правовых рамок, регулирующих использование ИИ в военных целях.

В то же время внезапное увольнение Сэма Альтмана с поста генерального директора OpenAI вызвало волну обеспокоенности по поводу процессов надзора и принятия решений в ведущей организации в индустрии искусственного интеллекта. Этотdent выявил более глубокие неопределенности в отношении тонкостей разработки и использования ИИ, вопрос, который оставался несколько неясным даже до того, как эти внутренние проблемы стали достоянием общественности.

В глобальном масштабе законодатели сталкиваются с трудностями, связанными с быстрым развитием технологий искусственного интеллекта. Их борьба за разработку нормативных актов и механизмов надзораdent. Темпы инноваций в области ИИ значительно опережают разработку правовых и этических норм. Этот разрыв создает значительные риски не только в военных приложениях, но и в различных секторах, где ИИ быстро внедряется.

Тревожные последствия применения ИИ для человеческих жизней в Газе и кризис управления OpenAI

Применение ИИ в конфликте в Газе подчеркивает мрачную реальность. Системы ИИ, лишенные человеческой эмпатии, выбирают цели. В результате происходят жертвы среди гражданского населения, в том числе тревожное количество детей, что рисует ужасающую картину потенциального злоупотребления ИИ. Эта ситуация требует критического анализа роли ИИ в войне, подчеркивая необходимость строгих этических стандартов и человеческого контроля в военных операциях, управляемых ИИ.

Ведущая исследовательская организация в области искусственного интеллекта OpenAI недавно столкнулась со значительными проблемами в сфере управления. Неожиданное увольнение генерального директора Сэма Альтмана вызвало дискуссии о прозрачности и контроле в разработке ИИ. Этотdent подчеркивает более широкие проблемы управления влиятельными организациями, занимающимися ИИ. Отсутствие ясности и подотчетности в этих организациях представляет риск не только для этичного развития ИИ, но и для общественного доверия к этим технологиям.

Значительный defiзнаний в государственных органах об искусственном интеллекте усугубляет проблему регулирования. Этот пробел, в сочетании со сложностями бюрократии и опасениями по поводу препятствования использованию преимуществ ИИ, привел к либеральному подходу к управлению ИИ. В результате компании, занимающиеся ИИ, в том числе разрабатывающие потенциально революционные технологии, работают с минимальным контролем. Этот неконтролируемый рост ИИ, особенно в таких чувствительных областях, как военное применение, вызывает серьезную озабоченность.

Уроки войны в Газе: недостатки ИИ или преднамеренное злоупотребление им со стороны Израиля?

Военные по всему миру внимательно следят за безжалостным применением ИИ в Газе, что потенциально может создать негативный прецедентdent будущих конфликтов. Способствует ли этическая несостоятельность ИИ глобальной обеспокоенности, или же это преднамеренное использование Израилем ИИ для массового уничтожения? Уроки, извлеченные из этой ситуации, могут повлиять на разработку и применение ИИ в других военных контекстах. Этот сценарий подчеркивает острую необходимость международного диалога об этическом использовании ИИ в войне, с акцентом на предотвращение жертв среди гражданского населения и обеспечение подотчетности.

Ситуация в Газе и проблемы управления в OpenAI знаменуют собой поворотный момент. Это отход от нарратива о том, что ИИ безоговорочно приведет к лучшему миру. Могут ли опасения по поводу злоупотребления ИИ, включая потенциальные преднамеренные действия, изменить эту траекторию? Потенциал ИИ в оказании помощи человечеству в достиженииdentцелей неоспорим. Тем не менее, его разработка в условиях секретности и применение в ситуациях, угрожающих жизни, требуют более критического и этичного подхода. Эффективное регулирование и надзор имеют решающее значение для обеспечения позитивного влияния ИИ на общество.

Будущее искусственного интеллекта – призыв к ответственным инновациям

По мере дальнейшего развития ИИ его влияние на общество и военные действия становится все более глубоким. Нынешняя нормативно-правовая и этическая база отстает от этого стремительного развития. Правительства и международные организации должны ускорить создание надежных рамок регулирования ИИ. Эти рамки должны отдавать приоритет этическим соображениям, прозрачности и подотчетности, особенно в таких важных областях, как военные действия. Только благодаря ответственным инновациям ИИ сможет действительно принести пользу человечеству, не причинив непоправимого вреда.

Двойственная роль ИИ — инструмента прогресса и потенциального орудия разрушения — сейчасdent как никогда.dentв Газе и в OpenAI служат тревожным сигналом. Они подчеркивают необходимость сбалансированного подхода к развитию ИИ, который признает его преимущества, одновременно критически оценивая риски. Поскольку ИИ продолжает преобразовывать наш мир, необходимы коллективные усилия для ответственного использования его потенциала, обеспечивая его служение общему благу без ущерба для этических стандартов.