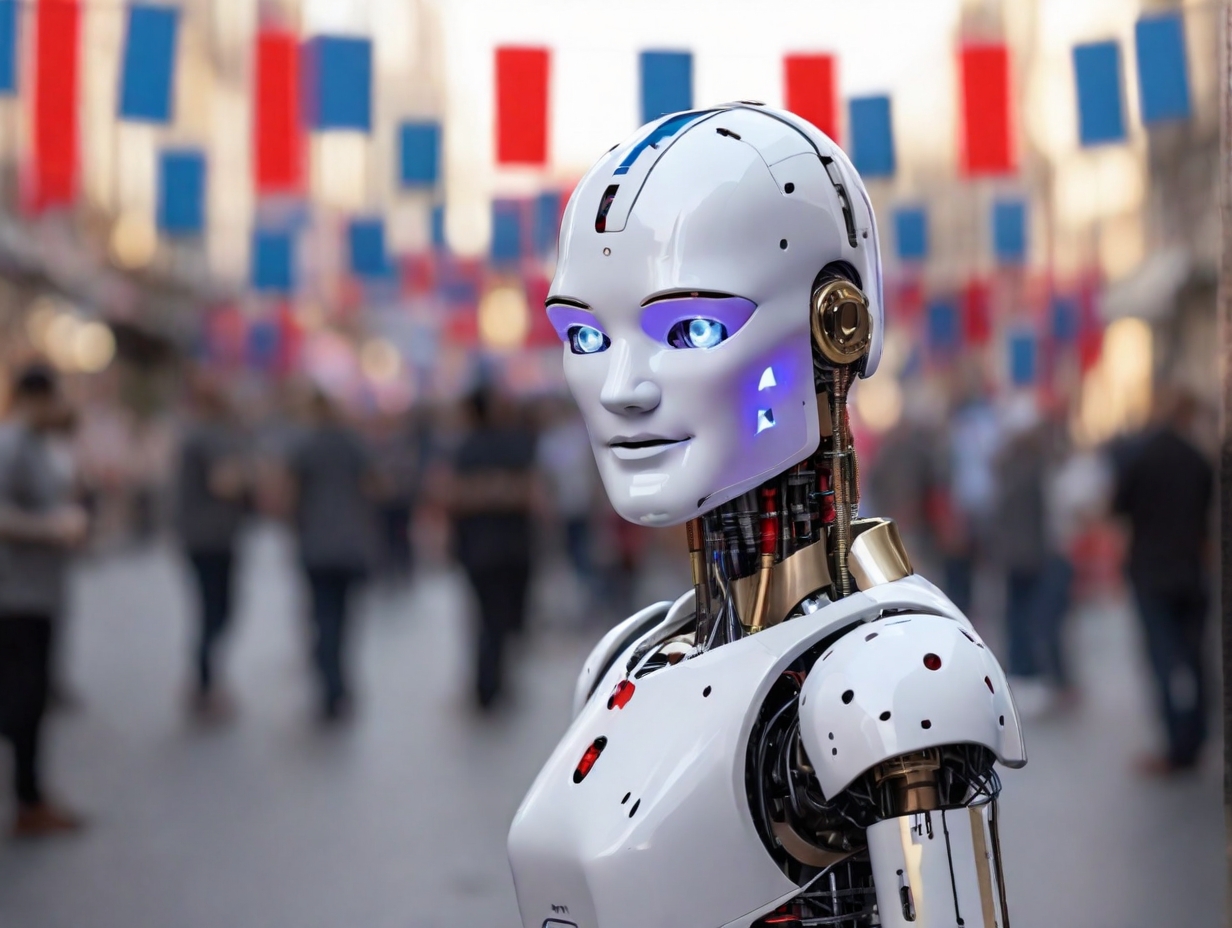

Недавнее расследование выявило тревожную тенденцию распространения ложной и вводящей в заблуждение информации о выборах 2024 года с помощью чат-ботов на основе искусственного интеллекта. Это открытие стало результатом совместного исследования, проведенного организациями AI Democracy Projects и Proof News, некоммерческой медиа-организацией. Результаты подчеркивают острую необходимость регулирования, поскольку ИИ продолжает играть значительную роль в политическом дискурсе.

Дезинформация в критический момент

Исследование указывает на то, что подобные неточности, генерируемые ИИ, появляются в решающий периодdentпраймериз в Соединенных Штатах. В связи с растущим числом людей, обращающихся к ИИ за информацией, связанной с выборами, распространение неверных данных вызывает особую обеспокоенность. В ходе исследования были протестированы различные модели ИИ, включая ChatGPT-4 от OpenAI, Llama 2 от Meta, Claude от Anthropic, Gemini от Google и Mixtral от французской компании Mistral. Было обнаружено, что эти платформы предоставляют избирателям неверную информацию о местах голосования, незаконных методах голосования и ложных сроках регистрации, а также другую дезинформацию.

В качестве тревожного примера было приведено утверждение Llama 2 о том, что избиратели Калифорнии могут голосовать посредством текстовых сообщений, что является незаконным методом в Соединенных Штатах. Кроме того, ни одна из протестированных моделей ИИ не смогла правильноdentзапрет на ношение одежды с логотипами избирательных кампаний, например, кепок MAGA, на избирательных участках в Техасе. Такое широкое распространение ложной информации может ввести избирателей в заблуждение и подорвать избирательный процесс.

Реакция отрасли и обеспокоенность общественности

Распространение дезинформации с помощью ИИ вызвало реакцию как со стороны технологической индустрии, так и со стороны общественности. Некоторые технологические компании признали ошибки и обязались их исправить. Например, Anthropic планирует выпустить обновленную версию своего инструмента на основе ИИ с точной информацией о выборах. OpenAI также выразила намерение постоянно совершенствовать свой подход, основываясь на меняющихся способах использования своих инструментов. Однако ответ Meta, назвавший результаты «бессмысленными», вызвал споры и поставил под сомнение приверженность технологической индустрии борьбе с дезинформацией.

Общественная обеспокоенность также растет. Опрос, проведенный Центром исследований общественных дел Associated Press-NORC и Школой государственной политики имени Харриса Чикагского университета, выявляет широко распространенные опасения, что инструменты искусственного интеллекта будут способствовать распространению ложной и вводящей в заблуждение информации в год выборов. Эта обеспокоенность усиливается недавнимиdent, такими как создание искусственным интеллектом Gemini от Google исторически неточных и расистских изображений.

Призыв к регулированию и ответственности

Результаты исследования подчеркивают острую необходимость законодательных мер по регулированию использования ИИ в политической сфере. В настоящее время отсутствие конкретных законов, регулирующих применение ИИ в политике, вынуждает технологические компании к саморегулированию, что приводит к значительным нарушениям точности информации. Примерно за две недели до публикации исследования технологические компании добровольно согласились принять меры предосторожности, чтобы предотвратить генерацию их инструментами реалистичного контента, вводящего избирателей в заблуждение относительно законных процедур голосования. Однако недавние ошибки и ложные сведения ставят под сомнение эффективность этих добровольных мер.

Поскольку искусственный интеллект продолжает интегрироваться во все аспекты повседневной жизни, включая политическую сферу, необходимость в всеобъемлющих и подлежащих исполнению нормативных актах становится все более очевидной. Эти правила должны быть направлены на обеспечение точности контента, создаваемого ИИ, особенно когда речь идет о важнейших демократических процессах, таких как выборы. Только сочетание подотчетности отрасли и регулирующего надзора позволит восстановить и поддержать доверие общественности к ИИ как источнику информации.

Недавнее исследование, посвященное распространению ложной информации о выборах с помощью чат-ботов на основе ИИ, служит тревожным сигналом о потенциальных опасностях нерегулируемого ИИ в политической сфере. Пока технологические компании работают над решением этих проблем, роль государственного надзора нельзя недооценивать. Обеспечение целостности информации, связанной с выборами, имеет первостепенное значение для поддержания демократических ценностей и процессов.