I grandi modelli multimodali sono la chiave per comprendere le macchine simili a quelle umane?

- Gli LMM rivoluzionano l'intelligenza artificiale integrando testo, immagini e audio, facilitando diverse interazioni e supportando la navigazione web per le persone ipovedenti.

- Gli LMM offrono interfacce versatili, che risultano vantaggiose per settori come quello sanitario, poiché consentono di amalgamare i dati per migliorare le prestazioni in attività come la diagnosi medica.

- L'intelligenza artificiale multimodale colma le lacune di percezione, promettendo progressi nel processo decisionale e nelle funzioni sociali con l'evoluzione dei LMM.

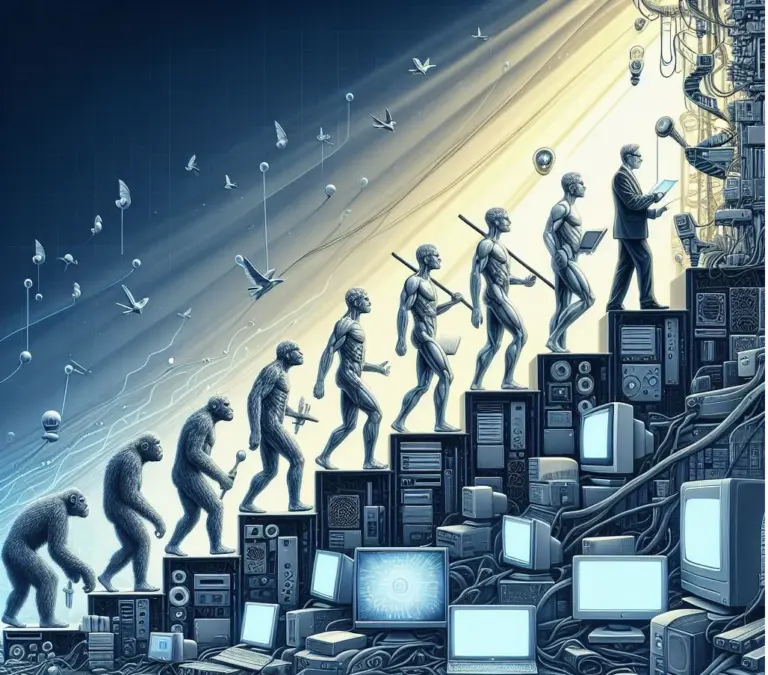

Nel campo dell'intelligenza artificiale (IA), si sta verificando una svolta significativa con l'emergere dei Large Multimodal Models (LMM), che segnano il passaggio dall'apprendimento unimodale a quello multimodale. Questa evoluzione rappresenta un momento cruciale nella ricerca e nello sviluppo dell'IA, poiché gli LMM integrano diverse modalità di dati, tra cui testo, immagini e audio, in un framework unificato. Mentre l'IA si sforza di emulare capacità simili a quelle umane, l'adozione di modelli multimodali è fondamentale. Questo articolo approfondisce la traiettoria degli LMM, le loro applicazioni in tutti i settori e le implicazioni future di questa tecnologia trasformativa.

Dai modelli unimodali ai grandi modelli multimodali

I Large Multimodal Models (LMM) rappresentano un allontanamento dai tradizionali sistemi unimodali, in cui l'IA operava all'interno di singole modalità di dati. Incorporando più modalità, gli LMM offrono una comprensione del mondo più completa, simile a quella dell'intelligenza umana. Questo cambio di paradigma ha profonde implicazioni per vari ambiti, tra cui l'elaborazione del linguaggio, la visione artificiale e il riconoscimento audio. Gli LMM consentono un'interazione fluida attraverso diversi mezzi, come l'input di testo, i comandi vocali e l'elaborazione delle immagini. In particolare, applicazioni come l'assistenza alle persone ipovedenti nella navigazione web sottolineano l'importanza pratica dell'IA multimodale.

I modelli LMM rappresentano un significativo progresso nella capacità dell'IA di elaborare e comprendere dati multimodali. A differenza dei modelli unimodali, che si limitano a elaborare i dati all'interno di una singola modalità, i modelli LMM possiedono la capacità di analizzare e interpretare informazioni provenienti da diverse fonti simultaneamente. Questo approccio olistico non solo migliora la comprensione da parte dell'IA di scenari reali complessi, ma apre anche le porte ad applicazioni innovative in diversi settori.

Versatilità e applicazione degli LMM

La versatilità dei Grandi Modelli Multimodali (LMM) si estende a tutti i settori, consentendo applicazioni diverse precedentemente inaccessibili. Settori come sanità, robotica, e-commerce e gaming trarranno notevoli vantaggi dall'integrazione di funzionalità multimodali. Combinando dati provenienti da diverse modalità, gli LMM migliorano le prestazioni e forniscono informazioni più dettagliate. Ad esempio, in ambito sanitario, gli LMM possono analizzare immagini mediche insieme a referti testuali, facilitando diagnosi accurate e una pianificazione del trattamento.

L'integrazione di modelli multimodali di grandi dimensioni (LMM) nelle piattaforme di e-commerce rivoluziona l'esperienza del cliente, fornendo raccomandazioni personalizzate basate sia sulle descrizioni testuali che sugli attributi visivi dei prodotti. Questa convergenza di modalità di dati consente suggerimenti più accurati e personalizzati, migliorando così la soddisfazione degli utenti e stimolando la crescita aziendale.

Prospettive future degli LLM

Sebbene sia ancora in una fase iniziale, l'intelligenza artificiale multimodale è estremamente promettente per il futuro dell'intelligenza artificiale. La convergenza di comprensione del linguaggio, visione artificiale ed elaborazione audio in un unico framework annuncia una nuova era di comprensione delle macchine. Con la continua evoluzione dei Large Multimodal Models (LMM), questi sono destinati a colmare il divario tra percezione umana e comprensione delle macchine. Guardando al futuro, si prevede che l'integrazione di capacità multimodali rivoluzionerà diversi aspetti della società, dall'assistenza personalizzata ai processi decisionali migliorati.

Lo sviluppo di Grandi Modelli Multimodali (LMM) rappresenta una pietra miliare significativa nel percorso dell'IA verso il raggiungimento di una comprensione e un'interazione a livello umano. Sfruttando i dati multimodali, gli LMM possono discernere modelli e correlazioni complesse che altrimenti rimarrebbero inosservati dai sistemi unimodali. Questo approccio olistico non solo migliora la capacità dell'IA di interpretare i fenomeni del mondo reale, ma promuove anche una più profonda integrazione tra esseri umani e macchine, aprendo la strada a relazioni più simbiotiche in vari ambiti.

Mentre i modelli multimodali di grandi dimensioni (LMM) aprono la strada a un approccio più integrato all'intelligenza artificiale, non si può fare a meno di chiedersi: quali nuovi orizzonti si apriranno con il continuo progresso dell'intelligenza artificiale multimodale e come plasmerà il futuro panorama dell'interazione uomo-macchina? Il percorso verso capacità di intelligenza artificiale multimodale avanzate è una frontiera entusiasmante, promettente per progressi trasformativi che ridefinirannodeficonfini dell'innovazione tecnologica e della collaborazione umana.

Non limitarti a leggere le notizie sulle criptovalute. Cerca di capirle. Iscriviti alla nostra newsletter. È gratis.

Disclaimer. Le informazioni fornite non costituiscono consulenza di trading. Cryptopolitan/ non si assume alcuna responsabilità per gli investimenti effettuati sulla base delle informazioni fornite in questa pagina. Consigliamotronvivamente di effettuare ricerche indipendentident di consultare un professionista qualificato prima di prendere qualsiasi decisione di investimento.

Aamir Sheikh

Aamir è un giornalista tecnologico con quasi sei anni di esperienza nel settore delle criptovalute e della tecnologia. Si è laureato alla MAJ University con un MBA in Finanza e Marketing. Attualmente lavora per Cryptopolitan, dove si occupa di reportage sugli ultimi sviluppi dei mercati delle criptovalute e di previsioni sui prezzi.

- Quali criptovalute possono farti guadagnare

- Come rafforzare la sicurezza del tuo portafoglio digitale (e quali sono quelli davvero validi)

- Strategie di investimento poco conosciute utilizzate dai professionisti

- Come iniziare a investire in criptovalute (quali piattaforme di scambio utilizzare, le migliori criptovalute da acquistare, ecc.)