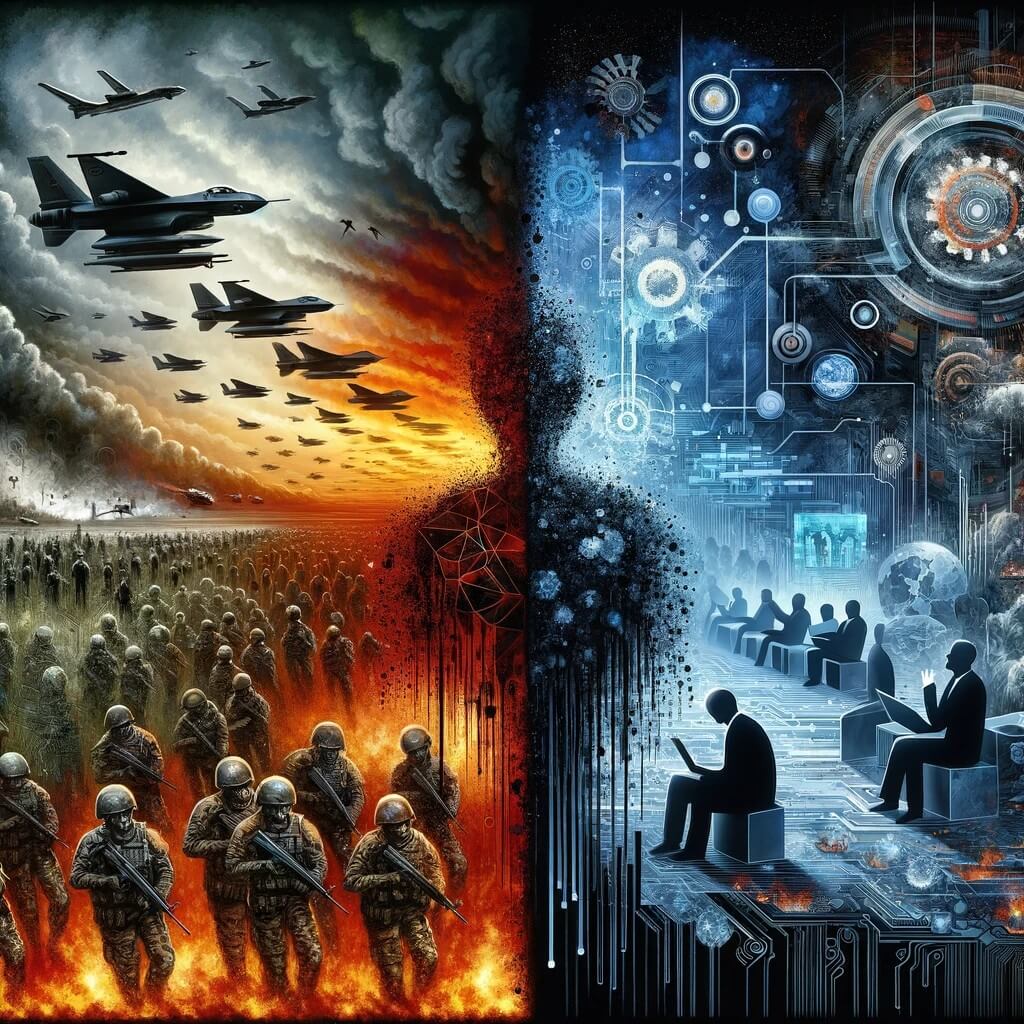

À l'heure où l'impact de l'intelligence artificielle (IA) sur la guerre et la gouvernance d'entreprise est considérable, l'équilibre éthique entre innovation et responsabilité est plus précaire que jamais. L'intégration de l'IA dans les opérations militaires a atteint un tournant décisif.

Les conflits récents, notamment à Gaza, mettent en lumière l'utilisation alarmante de l'IA dans les décisions cruciales. Le programme d'IA de l'armée israélienne, « The Gospel », en est un exemple frappant. Il accélère l'dentdes cibles, qu'elle soit correcte ou non, soulevant des questions éthiques quant à l'augmentation des victimes civiles, y compris des enfants. Cette escalade de la guerre pilotée par l'IA exige une réévaluation urgente des limites éthiques et des cadres réglementaires régissant l'utilisation de l'IA dans les contextes militaires.

Dans le même temps, le limogeage soudain de Sam Altman de son poste de directeur général d'OpenAI a suscité une vague d'inquiétudes quant aux processus de supervision et de prise de décision au sein de cette organisation de premier plan dans le secteur de l'IA. Cetdent a révélé des incertitudes plus profondes concernant les subtilités du développement et de l'utilisation de l'IA, une question qui était déjà quelque peu obscure avant que ces difficultés internes ne soient mises au jour.

À l'échelle mondiale, les législateurs sont confrontés à l'évolution rapide de l'intelligence artificielle. Leur difficulté à établir des réglementations et des mécanismes de contrôle estdent. Le rythme de l'innovation en IA dépasse largement celui du développement de cadres juridiques et éthiques. Ce décalage représente des risques importants, non seulement pour les applications militaires, mais aussi dans divers secteurs où l'IA se généralise rapidement.

Le bilan alarmant de l'IA sur les vies humaines à Gaza et la crise de gouvernance d'OpenAI

Le recours à l'IA dans le conflit de Gaza met en lumière une sombre réalité. Dépourvus d'empathie humaine, les systèmes d'IA sélectionnent leurs cibles. Les pertes civiles qui en résultent, dont un nombre alarmant d'enfants, illustrent de façon effroyable les risques de détournement de l'IA. Cette situation exige un examen critique du rôle de l'IA dans la guerre, soulignant la nécessité de normes éthiques rigoureuses et d'un contrôle humain strict des opérations militaires pilotées par l'IA.

OpenAI, un organisme de recherche de premier plan en intelligence artificielle, a récemment traversé une crise de gouvernance majeure. Le limogeage inattendu de son PDG, Sam Altman, a relancé le débat sur la transparence et le contrôle du développement de l'IA. Cetdent met en lumière les défis plus vastes que représente la gouvernance d'entités d'IA aussi puissantes. Le manque de clarté et de responsabilité au sein de ces organisations menace non seulement le développement éthique de l'IA, mais aussi la confiance du public envers ces technologies.

Le deficriant de connaissances en matière d'IA au sein des instances gouvernementales complexifie la réglementation. Ce déficit, conjugué aux lourdeurs bureaucratiques et aux craintes de freiner les avantages de l'IA, a engendré une approche laxiste de sa gouvernance. De ce fait, les entreprises spécialisées en IA, y compris celles développant des technologies potentiellement révolutionnaires, opèrent avec un contrôle minimal. Cette croissance incontrôlée de l'IA, notamment dans des domaines sensibles comme les applications militaires, est très préoccupante.

Leçons tirées de la guerre à Gaza : les lacunes de l’IA ou son utilisation abusive délibérée par Israël ?

Les forces armées du monde entier observent de près l' utilisation brutale de l'IA à Gaza, ce qui pourrait créer un précédent dangereuxdent les conflits futurs. Le manque d'éthique de l'IA contribue-t-il à cette inquiétude mondiale, ou s'agit-il d'un usage délibéré de l'IA par Israël à des fins de destruction massive ? Les enseignements tirés de cette situation pourraient influencer le développement et le déploiement de l'IA dans d'autres contextes militaires. Ce scénario souligne l'urgence d'un dialogue international sur l'utilisation éthique de l'IA dans la guerre, axé sur la prévention des pertes civiles et la garantie de la responsabilité.

La situation à Gaza et les problèmes de gouvernance chez OpenAI marquent un tournant. Ils remettent en question l'idée que l'IA conduira inévitablement à un monde meilleur. Les inquiétudes liées aux mésusages de l'IA, y compris d'éventuels actes délibérés, pourraient-elles modifier cette trajectoire ? Le potentiel de l'IA pour aider l'humanité à atteindre des objectifs sansdentest indéniable. Cependant, son développement dans le secret et son application dans des situations critiques exigent une approche plus critique et éthique. Une réglementation et un contrôle efficaces sont essentiels pour garantir l'impact positif de l'IA sur la société.

L'avenir de l'IA – Un appel à l'innovation responsable

À mesure que l'IA évolue, son impact sur la société et la guerre s'intensifie. Le cadre réglementaire et éthique actuel est en retard par rapport à cette évolution rapide. Les gouvernements et les instances internationales doivent accélérer la mise en place de cadres robustes pour encadrer l'IA. Ces cadres devraient privilégier les considérations éthiques, la transparence et la responsabilité, notamment dans les applications à haut risque comme la guerre. Seule une innovation responsable permettra à l'IA de véritablement bénéficier à l'humanité sans causer de dommages irréparables.

Le double rôle de l'IA, à la fois outil de progrès et instrument potentiel de destruction, est aujourd'hui plusdent que jamais. Lesdentsurvenus à Gaza et chez OpenAI sonnent l'alarme. Ils soulignent la nécessité d'une approche équilibrée du développement de l'IA, reconnaissant ses avantages tout en analysant de manière critique ses risques. Alors que l'IA continue de transformer notre monde, un effort collectif est indispensable pour exploiter son potentiel de manière responsable, en veillant à ce qu'elle serve le bien commun sans compromettre les normes éthiques.