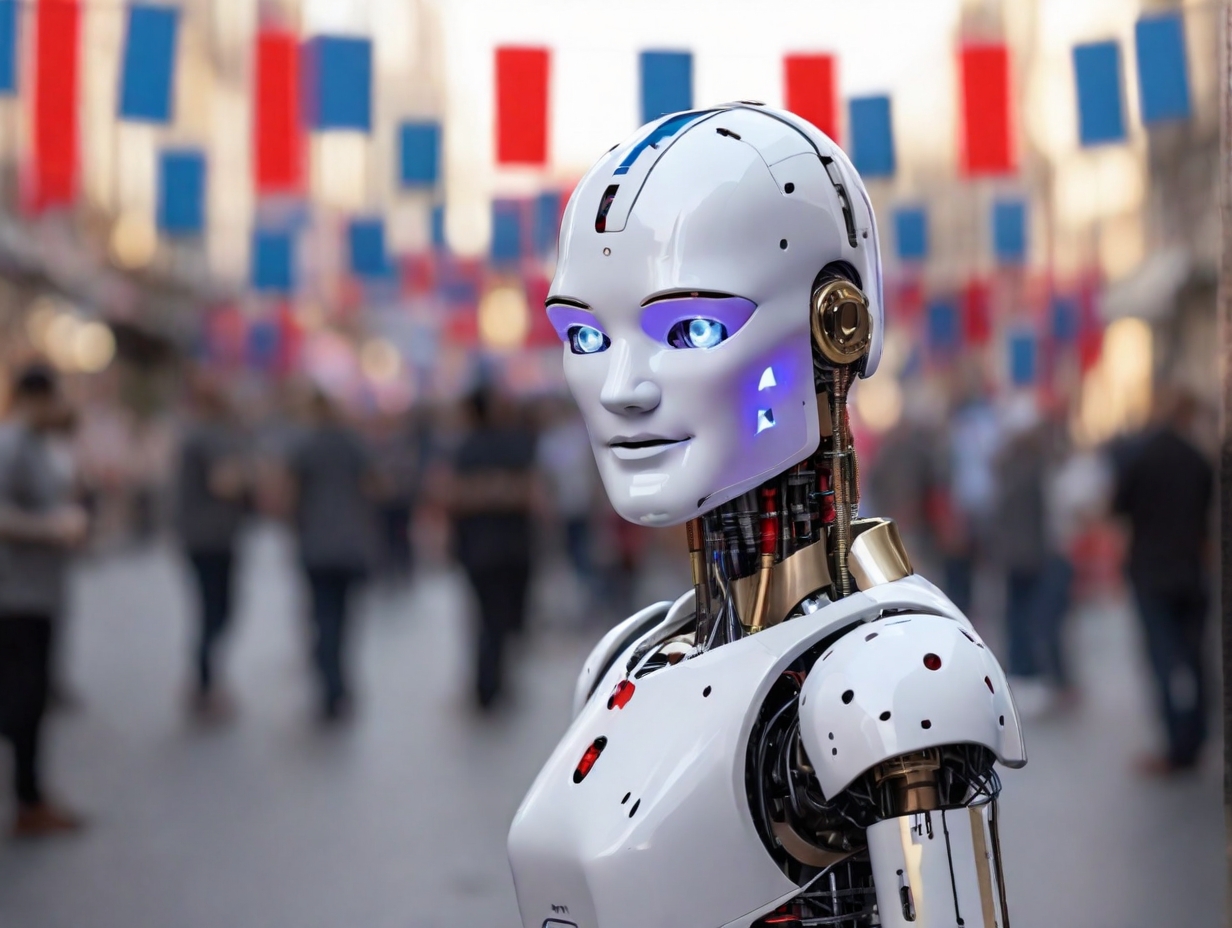

Une enquête récente a mis au jour une tendance inquiétante : des chatbots dotés d’intelligence artificielle diffusent des informations fausses et trompeuses concernant l’élection de 2024. Cette révélation provient d’une étude conjointe menée par AI Democracy Projects et Proof News, une organisation médiatique à but non lucratif. Les conclusions soulignent l’urgence d’une surveillance réglementaire, alors que l’IA continue de jouer un rôle important dans le débat politique.

Désinformation à un moment critique

L'étude souligne que ces inexactitudes générées par l'IA apparaissent durant la période cruciale des primairesdentaux États-Unis. Face à un nombre croissant de personnes se tournant vers l'IA pour obtenir des informations relatives aux élections, la diffusion de données erronées est particulièrement préoccupante. La recherche a testé différents modèles d'IA, notamment ChatGPT-4 d'OpenAI, Llama 2 de Meta, Claude d'Anthropic, Gemini de Google et Mixtral de Mistral, une entreprise française. Il a été constaté que ces plateformes fournissaient aux électeurs des adresses de bureaux de vote incorrectes, des méthodes de vote illégales et de fausses dates limites d'inscription, entre autres informations erronées.

Un exemple alarmant cité est l'affirmation de Llama 2 selon laquelle les électeurs californiens pouvaient voter par SMS, une méthode illégale aux États-Unis. De plus, aucun des modèles d'IA testés n'a correctementdentl'interdiction du port de vêtements arborant des logos de campagne, comme les casquettes MAGA, dans les bureaux de vote du Texas. Cette diffusion massive de fausses informations risque d'induire les électeurs en erreur et de compromettre le processus électoral.

Réaction de l'industrie et préoccupations du public

La propagation de la désinformation par l'IA a suscité des réactions tant du secteur technologique que du grand public. Certaines entreprises ont reconnu leurs erreurs et se sont engagées à les corriger. Par exemple, Anthropic prévoit de publier une version mise à jour de son outil d'IA intégrant des informations électorales précises. OpenAI a également exprimé sa volonté d'améliorer continuellement son approche en fonction de l'évolution des usages de ses outils. Cependant, la réaction de Meta, qui a qualifié les conclusions de « dénuées de sens », a déclenché une polémique et soulevé des questions quant à l'engagement réel du secteur technologique dans la lutte contre la désinformation.

L'inquiétude du public grandit également. Une enquête menée par l'Associated Press-NORC Center for Public Affairs Research et la Harris School of Public Policy de l'Université de Chicago révèle une crainte largement répandue que les outils d'intelligence artificielle contribuent à la diffusion d'informations fausses et trompeuses durant l'année électorale. Cette inquiétude est amplifiée par desdentrécents, tels que la production d'images historiquement inexactes et racistes par l'IA Gemini de Google.

L'appel à la réglementation et à la responsabilité

Les conclusions de l'étude soulignent l'urgence d'une action législative pour encadrer l'utilisation de l'IA en politique. Actuellement, l'absence de législation spécifique encadrant l'IA en politique laisse les entreprises technologiques s'autoréguler, une situation qui a engendré d'importantes lacunes dans la fiabilité de l'information. Environ deux semaines avant la publication de l'étude, ces entreprises s'étaient engagées volontairement à prendre des précautions pour empêcher leurs outils de générer des contenus réalistes susceptibles d'induire les électeurs en erreur sur les procédures de vote légales. Toutefois, les erreurs et les fausses informations récentes remettent en question l'efficacité de ces mesures volontaires.

À mesure que l'IA s'intègre davantage à tous les aspects de la vie quotidienne, y compris la sphère politique, la nécessité d'une réglementation complète et applicable se fait de plus en plus sentir. Cette réglementation devrait viser à garantir l'exactitude des contenus générés par l'IA, notamment lorsqu'il s'agit de processus démocratiques essentiels comme les élections. Seule une combinaison de responsabilisation du secteur et de contrôle réglementaire permettra de restaurer et de maintenir la confiance du public dans l'IA en tant que source d'information.

La récente étude sur les chatbots d'IA diffusant de fausses informations électorales sonne l'alarme quant aux dangers potentiels d'une IA non réglementée dans le domaine politique. Alors que les entreprises technologiques s'efforcent de résoudre ces problèmes, le rôle du contrôle gouvernemental ne saurait être sous-estimé. Garantir l'intégrité des informations relatives aux élections est primordial pour préserver les valeurs et les processus démocratiques.