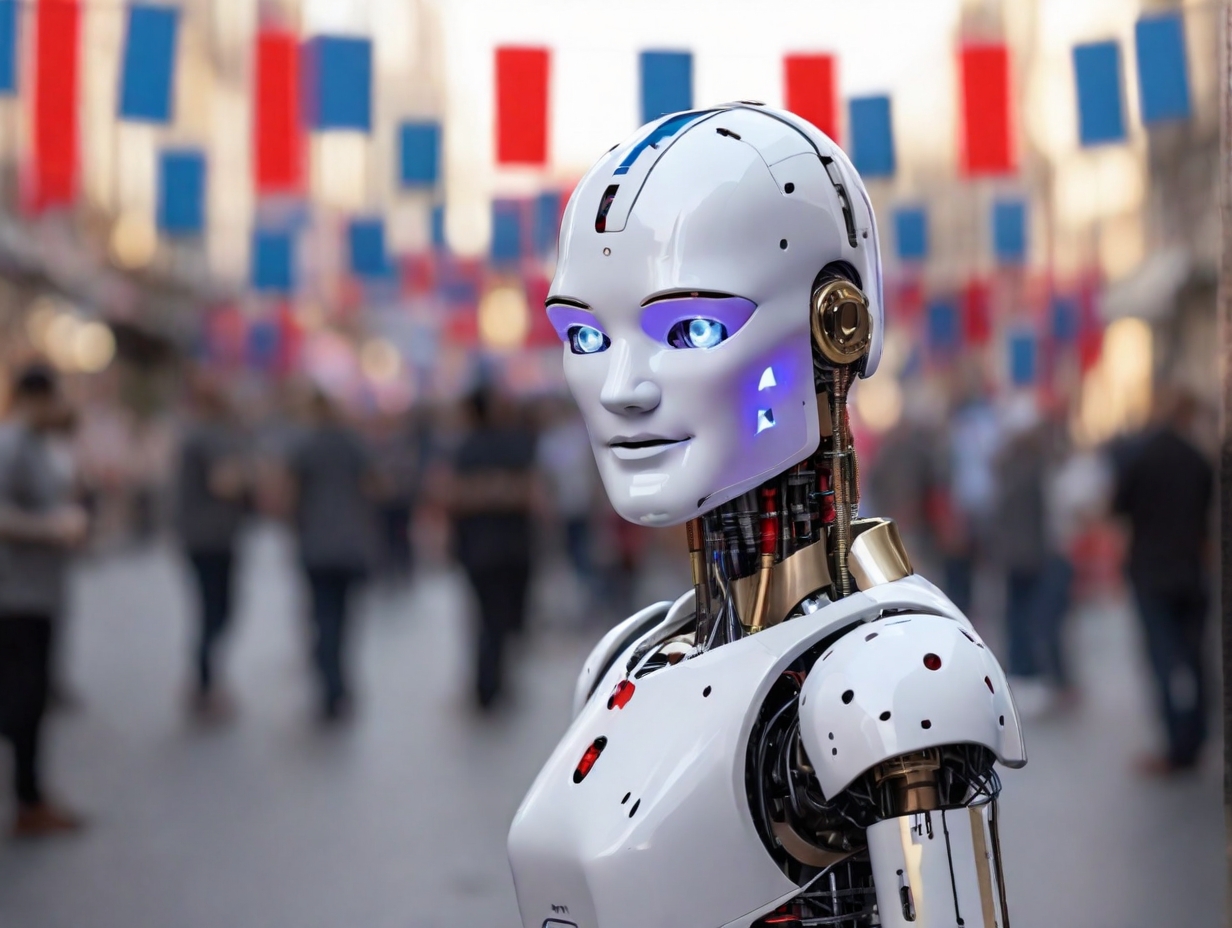

Una investigación reciente ha descubierto una preocupante tendencia a que los chatbots de IA difundan información falsa y engañosa sobre las elecciones de 2024. Esta revelación proviene de un estudio colaborativo realizado por AI Democracy Projects y Proof News, una organización de medios sin fines de lucro. Los hallazgos resaltan la urgente necesidad de supervisión regulatoria, ya que la IA sigue desempeñando un papel importante en el discurso político.

Desinformación en un momento crítico

El estudio señala que estas imprecisiones generadas por la IA están surgiendo durante el período crucial de las primariasdenten Estados Unidos. Con un número creciente de personas que recurren a la IA para obtener información electoral, la difusión de datos incorrectos es particularmente preocupante. La investigación probó varios modelos de IA, incluyendo ChatGPT-4 de OpenAI, Llama 2 de Meta, Claude de Anthropic, Gemini de Google y Mixtral de Mistral, de una empresa francesa. Se descubrió que estas plataformas proporcionaban a los votantes información errónea sobre centros de votación, métodos de votación ilegales y plazos de registro falsos, entre otros datos.

Un ejemplo alarmante citado fue la afirmación de Llama 2 de que los votantes de California podían emitir su voto por mensaje de texto, un método ilegal en Estados Unidos. Además, ninguno de los modelos de IA probadosdentcorrectamente la prohibición de usar vestimenta con logotipos de campaña, como gorras MAGA, en los colegios electorales de Texas. Esta difusión generalizada de información falsa tiene el potencial de engañar a los votantes y socavar el proceso electoral.

Respuesta de la industria y preocupación pública

La difusión de desinformación mediante IA ha provocado una respuesta tanto de la industria tecnológica como del público. Algunas empresas tecnológicas han reconocido los errores y se han comprometido a corregirlos. Por ejemplo, Anthropic planea lanzar una versión actualizada de su herramienta de IA con información electoral precisa. OpenAI también expresó su intención de perfeccionar continuamente su enfoque en función de la evolución en el uso de sus herramientas. Sin embargo, la respuesta de Meta, que desestimó los hallazgos como "sin sentido", ha generado controversia y cuestionado el compromiso de la industria tecnológica para frenar la desinformación.

La preocupación pública también está creciendo. Una encuesta del Centro de Investigación de Asuntos Públicos de Associated Press-NORC y la Escuela de Políticas Públicas Harris de la Universidad de Chicago revela un temor generalizado de que las herramientas de IA contribuyan a la difusión de información falsa y engañosa durante el año electoral. Esta preocupación se ve agravada pordentrecientes, como la generación de imágenes históricamente inexactas y racialmente insensibles por parte de la IA Gemini de Google.

El llamado a la regulación y la responsabilidad

Los hallazgos del estudio subrayan la urgente necesidad de medidas legislativas para regular el uso de la IA en contextos políticos. Actualmente, la falta de leyes específicas que regulen la IA en la política obliga a las empresas tecnológicas a autorregularse, lo que ha provocado importantes deficiencias en la precisión de la información. Aproximadamente dos semanas antes de la publicación del estudio, las empresas tecnológicas acordaron voluntariamente adoptar precauciones para evitar que sus herramientas generaran contenido realista que desinformara a los votantes sobre los procedimientos legales de votación. Sin embargo, los recientes errores y falsedades ponen en duda la eficacia de estas medidas voluntarias.

A medida que la IA se integra cada vez más en todos los aspectos de la vida cotidiana, incluida la esfera política, se hace cada vez más evidente la necesidad de regulaciones integrales y de cumplimiento obligatorio. Estas regulaciones deben garantizar la precisión del contenido generado por IA, especialmente en procesos democráticos cruciales como las elecciones. Solo mediante una combinación de rendición de cuentas de la industria y supervisión regulatoria se podrá restaurar y mantener la confianza pública en la IA como fuente de información.

El reciente estudio sobre chatbots de IA que difunden mentiras electorales sirve como una llamada de atención sobre los posibles peligros de la IA no regulada en el ámbito político. Mientras las empresas tecnológicas trabajan para abordar estos problemas, no se puede subestimar el papel de la supervisión gubernamental. Garantizar la integridad de la información electoral es fundamental para defender los valores y procesos democráticos.