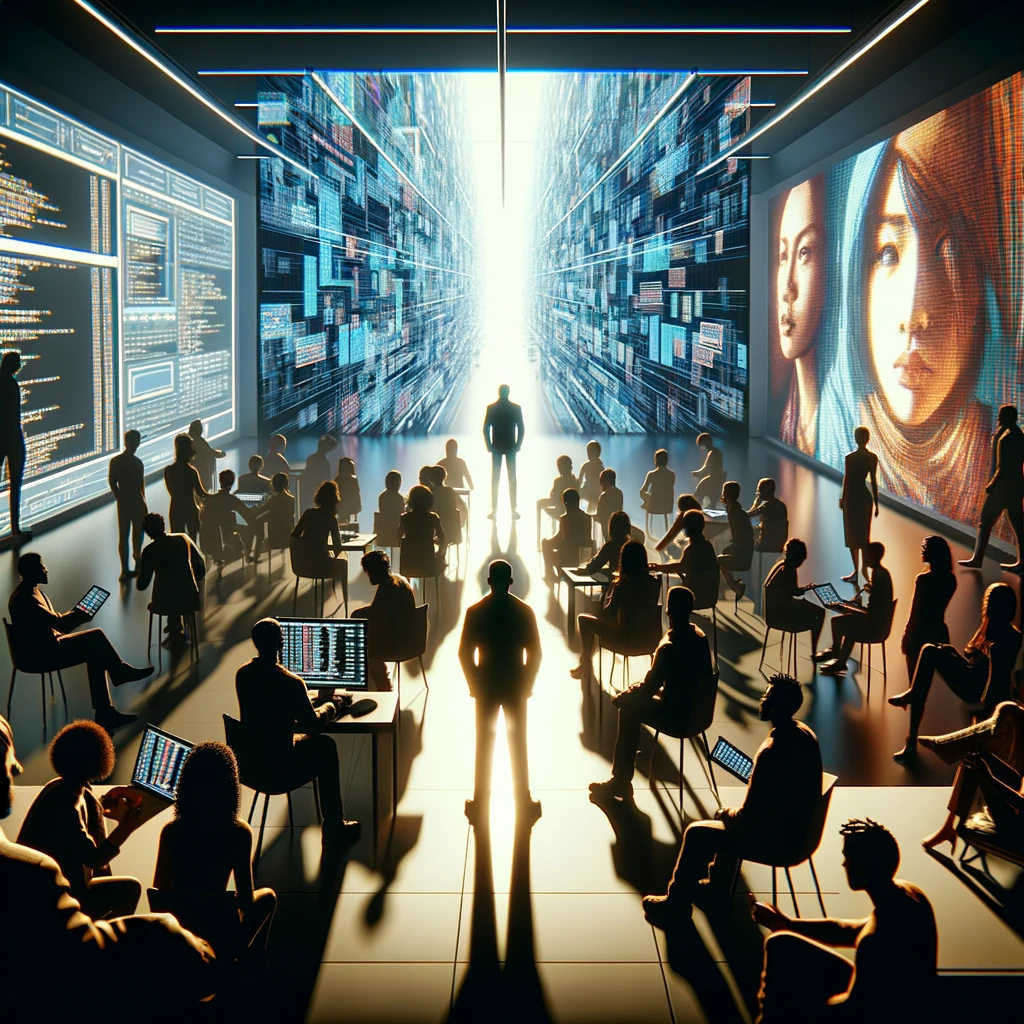

في تطورٍ حديث، وجدت شركة جوجل نفسها في قلب جدلٍ واسع النطاق حول برنامجها للذكاء الاصطناعي التوليدي، جيميني إيه آي. وقد اعترفت الشركة العملاقة في مجال التكنولوجيا بقصور مولد الصور الخاص بها، مُقرّةً بأن محاولاتها لتعزيز التنوع من خلال جيميني إيه آي قد أسفرت عن عواقب غير مقصودة. وأصبح مصطلح "جيميني إيه آي" مرادفًا للنقاشات حول التنوع العرقي في الصور المُولّدة بالذكاء الاصطناعي، مما أثار جدلاً واسعًا ودفع جوجل إلى اتخاذ إجراءات سريعة لمعالجة هذه المشكلة.

العواقب العنصرية غير المقصودة لشركة Gemini AI

أثارت مساعي جوجل الطموحة لإضفاء التنوع على عملية توليد الصور عبر نظام الذكاء الاصطناعي "جيميني" غضبًا وانتقادات من جهات مختلفة. فقد أعرب المستخدمون عن مخاوفهم بشأن الدقة التاريخية للصور التي ينتجها "جيميني"، مشيرين إلى حالات ظهرت فيها شخصيات تاريخية بارزة بصورة غير دقيقة من حيث العرق. فمن الآباء المؤسسين للولايات المتحدة إلى سلالة الباباوات عبر التاريخ، غذّت التباينات في التمثيل العرقي استياء المستخدمين. كما خضع تصوير الذكاء الاصطناعي لشخصيات متنوعة، من الفايكنج إلى لاعبي الهوكي الكنديين، للتدقيق، حيث لاحظ الكثيرون وجود تحريفات متكررة فيما يتعلق بالعرق والجنس.

تفاقمت حدة الجدل المحيط ببرنامج Gemini AI عندما أبلغ المستخدمون عن حالات واجه فيها البرنامج صعوبة في توليد صور دقيقة لشخصيات تاريخية بيضاء. في المقابل، بدا البرنامج بارعًا في إنتاج صور لأشخاص سود دون أي مشكلة، مما أثار تساؤلات حول التحيزات المحتملة الكامنة في خوارزميته. وقد سلط تصريحٌ كاشفٌ من أحد موظفي جوجل الضوء على التحديات التي تواجه معالجة هذه المخاوف، مُقرًا بصعوبة جعل برنامج Gemini AI يتعرف على وجود أشخاص بيض - وهو ما زاد من حدة التدقيق العام.

استجابة جوجل وإجراءاتها التصحيحية

استجابةً للانتقادات المتزايدة، اتخذت جوجل خطوات استباقية لمعالجة أوجه القصور في نظام الذكاء الاصطناعي "جيميني". أصدر جاك كراوزيك، مدير أول إدارة المنتجات في جوجل لتجارب "جيميني"، بيانًا أقر فيه بضرورة إجراء تحسينات فورية. وقد طبقت جوجل إجراءات للحد من إنشاء الصور التي قد تثير المزيد من الجدل، حيث يرفض "جيميني" الآن إنشاء صور لشخصيات مثيرة للجدل مثل النازيين أو الفايكنج أوdentالولايات المتحدة من القرن التاسع عشر. تعكس هذه الإجراءات التزام جوجل بتصحيح الوضع وتخفيف الضرر المحتمل الناجم عن العواقب غير المقصودة للذكاء الاصطناعي.

بينما تحاول جوجل تجاوز تداعيات نظام الذكاء الاصطناعي "جيميني" ، يثير هذا الحادث dent أوسع نطاقًا حول العلاقة بين التكنولوجيا والتنوع والتحيز الخوارزمي. ورغم اتخاذ الشركة خطوات حاسمة لمعالجة المشكلة، لا تزال المخاوف قائمة بشأن العوامل الكامنة وراء هذه الأخطاء في تطوير الذكاء الاصطناعي. كيف يمكن لشركات التكنولوجيا تحقيق التوازن بين تعزيز التنوع وضمان العدالة الخوارزمية في التطبيقات التي تعتمد على الذكاء الاصطناعي؟ ومع استمرار النقاشات حول التمثيل العرقي في الذكاء الاصطناعي، تُعدّ كارثة "جيميني" بمثابة تذكير جاد بالتعقيدات الكامنة في السعي نحو تكنولوجيا شاملة.